Durante los años 2023 y 2024, el debate público sobre la inteligencia artificial se centró en las capacidades de los modelos de lenguaje, las métricas de razonamiento lógico y la adopción de interfaces conversacionales. El software parecía operar en un plano abstracto, desvinculado de las limitaciones del mundo físico. Se asumía que la progresión tecnológica respondería linealmente a las leyes de escalado algorítmico. Sin embargo, a medida que la industria cruza el segundo trimestre de 2026, el panorama revela una transformación radical. La inteligencia artificial ha dejado de ser una disciplina de software para convertirse en un problema de ingeniería civil, ciencia de materiales, termodinámica y logística de la cadena de suministro.

El punto de inflexión se originó con la transición de los modelos de entrenamiento basados en procesos por lotes hacia la era de la IA agente. Los sistemas actuales ya no se limitan a generar respuestas de texto bajo demanda, sino que ejecutan flujos de trabajo de manera autónoma, mantienen el contexto durante semanas e interactúan con miles de interfaces de programación (APIs) en tiempo real. Este cambio operativo exige una disponibilidad computacional ininterrumpida. “El resultado práctico es que el valor diferencial deja de ser ‘tengo el modelo que razona’ y pasa a ser ‘tengo el sistema que opera'”, según Alberto Muñoz en el estudio Menos magia, más ingeniería publicado por El Financiero. La comercialización masiva de estos sistemas agentes ha expuesto la vulnerabilidad subyacente del ecosistema: una dependencia absoluta de componentes de hardware que no pueden manufacturarse a la velocidad del código.

En abril de 2026, la industria tecnológica se enfrenta a un escenario donde el capital de inversión excede con creces la capacidad productiva de los fabricantes de semiconductores. Empresas que cotizan en bolsa, desde desarrolladoras de aplicaciones hasta firmas de automatización empresarial, reportan retrasos en el despliegue de sus productos debido a la imposibilidad de rentar tiempo de procesamiento. Los modelos predictivos que calculaban el crecimiento del sector fallaron al no contabilizar los tiempos de fraguado del cemento para nuevos centros de datos, los plazos de entrega de transformadores de alta tensión y los límites físicos de las máquinas de litografía.

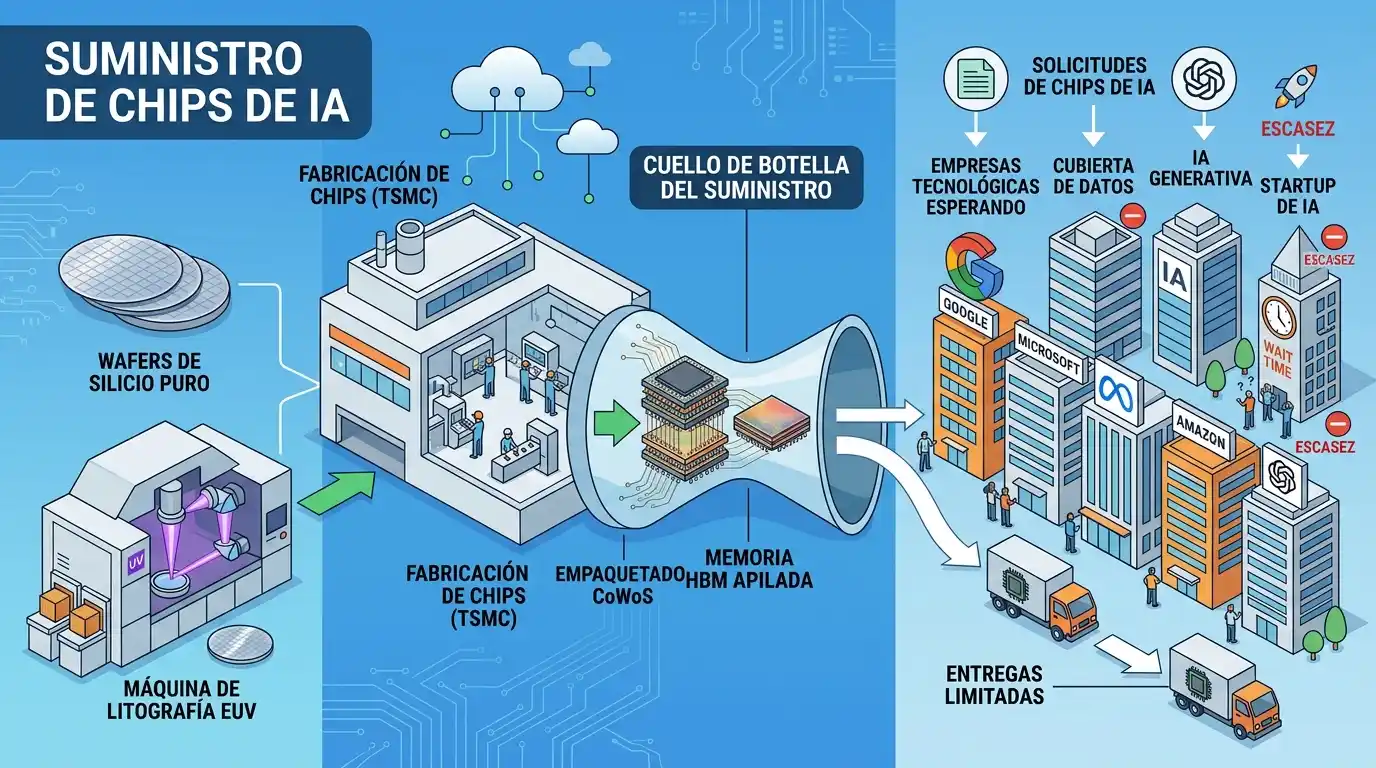

Este informe detalla las dimensiones del cuello de botella actual, estructurando el análisis en la crisis de manufactura de silicio y empaquetado avanzado, la saturación de las redes eléctricas a nivel global, el surgimiento de infraestructuras descentralizadas como medida de contingencia y las repercusiones en la cadena de suministro internacional.

La crisis de manufactura: Litografía, memoria y el cuello de botella del empaquetado avanzado

El concepto de escasez de procesadores gráficos (GPUs) requiere una precisión técnica. La restricción no reside en la impresión del bloque lógico central de los chips que diseñan empresas como Nvidia o AMD. El verdadero nudo logístico se localiza en los procesos de ensamblaje final y en la integración de componentes de memoria de alto rendimiento. En la arquitectura de hardware de 2026, un procesador de inteligencia artificial no es una pieza única de silicio, sino un mosaico de múltiples componentes ensamblados sobre una base de interconexión. Este proceso se conoce como empaquetado avanzado.

La fundición Taiwan Semiconductor Manufacturing Company (TSMC) domina el mercado global de este tipo de empaquetado mediante su tecnología CoWoS (Chip-on-Wafer-on-Substrate). La tecnología CoWoS permite instalar la unidad lógica de procesamiento y los módulos de memoria sobre un interpositor de silicio que facilita el intercambio de datos a velocidades de terabytes por segundo. La manufactura de estos sustratos presenta tasas de error considerables debido a las diferencias de expansión térmica de los materiales durante el proceso de soldadura a nivel microscópico. A pesar de que TSMC inició un programa de expansión, los reportes indican que la oferta es insuficiente. La compañía ha emitido comunicaciones directas a sus clientes sobre las restricciones. Según reporta la revista especializada Computing, TSMC ha informado a clientes clave que no puede satisfacer toda su demanda creciente de procesadores de IA avanzados debido a la limitación en los nodos de manufactura.

La dinámica de asignación de esta capacidad de empaquetado dicta el ritmo de la economía digital. De acuerdo con informes del sector, Nvidia ha asegurado aproximadamente el cincuenta por ciento de la capacidad total de producción CoWoS de TSMC proyectada para 2026. Esta concentración deja el porcentaje restante para ser dividido entre firmas como AMD, Intel y los proyectos de chips personalizados de operadores de centros de datos como Google (con sus unidades TPU), Amazon (Trainium) y Meta. Este escenario obliga a los competidores a operar con cuotas de suministro que no coinciden con sus previsiones de expansión comercial.

Paralelamente, la manufactura de memoria plantea una restricción de igual magnitud. La ejecución de modelos de IA, especialmente durante la fase de inferencia y operación de agentes autónomos, requiere memoria de alto ancho de banda (HBM, por sus siglas en inglés). La tecnología HBM3e, el estándar actual, se fabrica apilando capas de chips de memoria dinámica (DRAM) conectadas verticalmente mediante vías a través del silicio (TSV). Perforar orificios microscópicos y alinearlos a través de múltiples capas de silicio sin fracturar el cristal constituye uno de los procesos industriales de mayor complejidad del mundo. Los tres fabricantes globales de esta tecnología —SK Hynix, Micron y Samsung— han agotado su capacidad de producción. “De cara a 2026, el principal riesgo no será la demanda, que sigue creciendo, sino la capacidad de ejecución y adaptación de la industria para responder a ese ritmo”, según los analistas citados en el estudio de Estrategias de Inversión sobre la escasez de memoria.

La presión retrocede un paso adicional en la cadena de valor hasta llegar a los proveedores de maquinaria. Para producir componentes de la densidad requerida, las fundiciones dependen de equipos de litografía ultravioleta extrema (EUV). La empresa neerlandesa ASML mantiene el monopolio en la fabricación de estas máquinas, que utilizan pulsos láser sobre gotas de estaño en cámaras de vacío para generar luz de longitudes de onda cortas. La tasa de producción de estas máquinas, que pesan cientos de toneladas y requieren múltiples aviones de carga para su transporte, representa un límite físico ineludible. “La restricción vinculante para la capacidad de chips de IA se ha desplazado desde el diseño de chips en Nvidia hacia la producción de fundición en Taiwan Semiconductor y los fabricantes de equipos semiconductores como ASML”, según Stacy Rasgon en el análisis publicado por 24/7 Wall St.

| Periodo | Capacidad Estimada (Obleas/mes) | Tasa de Expansión (%) | Estado del Mercado |

|---|---|---|---|

| Finales de 2024 | 35,000 | Base | Saturado |

| Finales de 2025 | 80,000 | +128% | Saturado |

| Finales de 2026 (Proyección) | 130,000 | +62% (Acumulado 271%) | Asignado en su totalidad |

Esta tabla refleja cómo, incluso con expansiones de capital multimillonarias por parte de TSMC, la matemática de la cadena de suministro global no logra cuadrar con las demandas de los operadores tecnológicos. La limitación estructural en la disponibilidad de equipos litográficos, sustratos y memoria apilada establece un techo a la cantidad de procesadores de IA que pueden existir en el mundo en un momento dado, independientemente del capital que las empresas estén dispuestas a invertir.

Saturación de infraestructura: El impacto en las redes eléctricas globales

Más allá de la disponibilidad de semiconductores, el funcionamiento de la infraestructura de inteligencia artificial requiere energía eléctrica en una escala que las redes de transmisión nacionales no están preparadas para suministrar. Un centro de datos tradicional, destinado a alojar servidores de correo electrónico, bases de datos corporativas o alojamiento web, presenta un requerimiento de potencia que oscila entre los diez y los treinta megavatios (MW). En contraste, las instalaciones proyectadas en 2026 para entrenamiento y operación de redes neuronales de frontera demandan cientos de megavatios, con proyectos a escala de gigavatio (1 GW) en fase de planificación. Para dimensionar esta cifra, un gigavatio equivale a la producción total de un reactor nuclear comercial estándar y puede abastecer a una ciudad de cientos de miles de habitantes.

La disparidad en el consumo se deriva de la densidad térmica de los equipos. Mientras que un gabinete de servidores en rack tradicional consume entre cinco y diez kilovatios, los bastidores equipados con sistemas como la arquitectura Blackwell de Nvidia superan los cien kilovatios. Esta densidad descarta el uso de sistemas de enfriamiento por aire convencionales. El aire carece de la capacidad calorífica necesaria para disipar las temperaturas generadas, lo que obliga a la implementación de sistemas de enfriamiento líquido directo al chip (Direct-to-Chip) o inmersión bifásica. Estos sistemas de refrigeración imponen una demanda de energía adicional que incrementa el índice de efectividad del uso de la energía (PUE) de las instalaciones.

La incorporación repentina de estas cargas de demanda masiva y sostenida desestabiliza las proyecciones de los operadores de redes eléctricas, que planifican expansiones en intervalos de décadas. “Esta falta de correspondencia está creando crecientes presiones en las redes eléctricas regionales, aumento de costos para los contribuyentes, retrasos en permisos y crecientes conflictos políticos y legales”, según los autores en el estudio de KTS Law sobre el marco regulatorio energético de 2026. Los desarrolladores de instalaciones descubren que el factor temporal restrictivo no es la construcción del edificio, sino los tiempos de espera para la adquisición e instalación de transformadores de alta y media tensión, así como los procesos de interconexión a la red, que en algunos distritos acumulan listas de espera de varios años.

En julio de 2024, el norte de Virginia —la región con mayor densidad de centros de datos en el mundo— experimentó un evento de inestabilidad de tensión que provocó la desconexión simultánea de sesenta instalaciones. El incidente forzó ajustes de emergencia en la red regional para evitar apagones en cadena. Situaciones similares se replican a nivel internacional. En Europa, el operador de red estatal de Dinamarca, Energine, interrumpió temporalmente la aceptación de nuevos acuerdos de interconexión debido a la recepción de solicitudes que totalizaban sesenta gigavatios, una cantidad que excedía la demanda pico nacional de siete gigavatios en más de un ochocientos por ciento. “A medida que aumenta esa demanda, se prevé que el consumo de energía de los centros de datos se duplique entre ahora y 2030”, según Mark Fenton en el análisis técnico para Big Think.

La matriz energética plantea un obstáculo adicional. Las empresas operadoras de centros de datos mantienen compromisos corporativos de neutralidad de carbono, lo que las obliga a buscar fuentes de energía renovable. Sin embargo, la generación eólica y solar presenta características de intermitencia que no se alinean con el perfil de consumo constante (carga base) requerido por el hardware de inteligencia artificial. Esta discrepancia fuerza a los operadores a considerar el uso continuo de plantas de ciclo combinado de gas natural, retrasando los objetivos de descarbonización, o a explorar inversiones directas en energía nuclear de pequeña escala (SMR, reactores modulares pequeños), una tecnología con ciclos de aprobación regulatoria prolongados.

| Año | Consumo Estimado (TWh) | Porcentaje del Consumo Nacional |

|---|---|---|

| 2023 | 176 | 4.4% |

| 2028 (Proyección Mínima) | 325 | 6.7% |

| 2028 (Proyección Máxima) | 580 | 12.0% |

Las cifras expuestas evidencian la transición operativa de la industria: el parámetro principal en la selección de sitios para nuevos centros de datos dejó de ser la latencia de fibra óptica hacia los centros urbanos y se convirtió exclusivamente en la proximidad y disponibilidad de generación eléctrica.

Respuestas técnicas del mercado: Descentralización y modularidad extrema

La consolidación de los recursos de cómputo en manos de proveedores de infraestructura en la nube (hyperscalers) ha generado un efecto de exclusión para entidades comerciales de menor tamaño, centros de investigación académicos y empresas emergentes. Al asegurar compromisos de suministro de años y firmar contratos de compra de energía a largo plazo, estas megacorporaciones establecen barreras de entrada funcionales. Ante la imposibilidad de competir en el mercado tradicional de arrendamiento de servidores en centros de datos, los desarrolladores de sistemas y los integradores buscan arquitecturas alternativas para ejecutar cargas de trabajo de inteligencia artificial.

Una de las respuestas sistémicas con mayor adopción en el primer semestre de 2026 es el uso de Redes de Infraestructura Física Descentralizada (DePIN, por sus siglas en inglés). Estas redes emplean protocolos de enrutamiento y plataformas de registro distribuido para agregar la capacidad de procesamiento de unidades gráficas dispersas geográficamente. En lugar de depender de clústeres monolíticos en instalaciones centralizadas de alto voltaje, las redes DePIN conectan hardware de consumo de alta gama, servidores de centros de datos de nivel regional y equipos previamente destinados a procesos criptográficos para formar grupos de procesamiento paralelos.

Plataformas como CUDOS Intercloud operan mediante un modelo de intermediación algorítmica. Un desarrollador de inteligencia artificial envía una solicitud de procesamiento a la red y el sistema fragmenta el trabajo, asignándolo a diferentes proveedores de hardware inactivo. “En lugar de depender de centros de datos centralizados, DePIN desbloquea recursos inactivos de GPU de operadores independientes, centros de datos y mineros, formando una supercomputadora global y descentralizada”, según el reporte técnico publicado en AI Journal. Esta metodología reduce los costos operativos y democratiza el acceso a la computación, aunque introduce desafíos inherentes de seguridad de datos, cifrado homomórfico y latencia de red, limitando su aplicación a procesos de inferencia por lotes, generación de datos sintéticos o validación de algoritmos de visión artificial en lugar de entrenamientos de modelos frontera de gran tamaño.

Desde el punto de vista de la infraestructura física, otra alternativa en expansión es el centro de datos modular y portátil. Estas instalaciones abandonan el modelo de construcción civil tradicional a favor de contenedores marítimos estandarizados (tipo ISO) equipados en fábricas. Cada módulo integra la infraestructura de potencia de Tecnología de la Información (TI), los circuitos de refrigeración líquida perimetral y los equipos de red. Una vez ensamblados, los contenedores se transportan mediante camiones articulados, trenes o barcos directamente hacia las ubicaciones de generación eléctrica, eliminando los años de retraso que implica la construcción de edificios dedicados.

En Australia, la empresa WinDC ha iniciado el despliegue comercial de estas unidades modulares con capacidades de hasta 1.6 megavatios por contenedor. La estrategia logística de WinDC consiste en ubicar físicamente el equipamiento informático en las instalaciones de plantas solares y eólicas. Las redes de transmisión sufren restricciones operativas que obligan a los generadores de energía renovable a detener su producción (un proceso conocido como curtailment) durante los momentos de máxima radiación o viento, debido a que los cables no tienen capacidad para transportar los electrones hacia las ciudades. “WinDC convierte la crisis de la red eléctrica de Australia en una ventaja estratégica, transformando la energía renovable desperdiciada en capacidad soberana de IA y una nueva industria de exportación”, según Andrew Sjoquist en la entrevista para la revista técnica ARNnet. Al instalar el consumo directamente en la fuente de generación, estas soluciones eluden el cuello de botella de la transmisión eléctrica y acceden a energía excedente a tarifas marginales.

Dependencia industrial, daños colaterales y la concentración geográfica asiática

El efecto de succión gravitacional que ejerce la demanda de componentes de inteligencia artificial perturba el equilibrio de la cadena de suministro de industrias no relacionadas directamente con el aprendizaje automático. Las líneas de manufactura de semiconductores operan bajo el principio de costo de oportunidad. Debido a que los procesadores diseñados para IA y los módulos de memoria HBM3e ofrecen los márgenes de ganancia operativa más altos del mercado, los fabricantes priorizan la asignación de sustratos de silicio y tiempo de máquina a estos productos. La consecuencia inmediata es la reducción en la producción de circuitos integrados lógicos tradicionales, sensores de gestión de energía y memoria convencional de grado automotriz y electrónica de consumo.

Firmas de análisis como S&P Global Mobility documentan la aparición de una segunda etapa de escasez de semiconductores, paralela a la crisis logística vivida a principios de la década. En esta ocasión, el impacto recae de forma aguda en la industria automotriz. Los vehículos modernos incorporan sistemas avanzados de asistencia a la conducción (ADAS), pantallas digitales e interfaces de telemetría que dependen de microcontroladores que utilizan nodos tecnológicos maduros y memorias flash. Los fabricantes de vehículos reportan limitaciones en sus previsiones de ensamblaje para el cierre de 2026 debido al re-direccionamiento del suministro de memoria hacia los centros de datos corporativos.

Esta reconfiguración consolida el papel de Asia Oriental como el punto focal único de la logística de hardware. Aunque las compañías radicadas en América del Norte y Europa lideran el desarrollo algorítmico, y la construcción de centros de datos se realiza de forma distribuida, los materiales físicos requeridos provienen de un corredor geográfico altamente concentrado. Taiwán monopoliza el ensamblaje lógico avanzado y el empaquetado CoWoS; Corea del Sur controla la producción de módulos HBM a través de las cuotas de mercado combinadas de SK Hynix y Samsung; y Japón lidera la provisión de los materiales químicos fotoprotectores necesarios para los equipos de litografía de ASML.

Esta dependencia trasciende los aspectos comerciales y genera implicaciones de seguridad nacional. “La explosión de los centros de datos está disparando la demanda y agotando las reservas de memorias Flash y DRAM, reforzando la dependencia tecnológica de Asia”, según Ignacio Mártil en el análisis de situación geopolítica tecnológica para El Confidencial. Las medidas de restricción de exportaciones impuestas por los gobiernos occidentales, que buscan evitar la llegada de aceleradores lógicos avanzados a mercados restringidos, provocan distorsiones adicionales en la disponibilidad de piezas. Antes de la implementación de fases de control restrictivo, empresas bajo la jurisdicción china ejecutaron pedidos de compra de millones de unidades procesadoras para asegurar abastecimiento, agotando los inventarios intermedios de los distribuidores globales y elevando los tiempos de entrega promedio de treinta semanas a plazos indefinidos que alcanzan el primer trimestre de 2027.

La evaluación del estado tecnológico en 2026 no permite obviar que el mayor limitante para la expansión de la inteligencia artificial de próxima generación no radica en la invención de nuevas redes neuronales o algoritmos de razonamiento lógico, sino en factores físicos de índole puramente mecánica. El conocimiento algorítmico se difunde y democratiza mediante repositorios abiertos, pero la capacidad real para ejecutar esos algoritmos a nivel comercial exige sortear barreras físicas de termodinámica de refrigeración, interconexión de transformadores de transmisión de gigavatios y manipulación atómica en fábricas de Taiwán y Corea del Sur. Aquellas entidades corporativas y estatales que logren orquestar el acceso simultáneo a obleas de silicio avanzado, memorias apiladas, capacidades de enfriamiento e interconexión eléctrica serán las que sostengan la viabilidad operativa en la era de los sistemas agentes.