Para entender el frenesí que ha rodeado al ecosistema digital en los últimos años, debemos retroceder un poco y observar cómo ha mutado la forma en que los seres humanos buscan información en internet. Durante más de dos décadas, la optimización para motores de búsqueda (SEO) se basó en un contrato implícito entre los webmasters y los gigantes tecnológicos, predominantemente Google. Los creadores de contenido estructuraban sus páginas web utilizando etiquetas HTML, optimizaban la velocidad de carga, conseguían enlaces entrantes y, a cambio, los motores de búsqueda enviaban tráfico humano a través de los famosos “diez enlaces azules”. Sin embargo, la irrupción masiva de la inteligencia artificial generativa destrozó por completo este paradigma. Los usuarios comenzaron a exigir respuestas directas, conversacionales y sintetizadas, sin la necesidad de hacer clic en múltiples sitios web para extraer la información por sí mismos.

A medida que plataformas como ChatGPT, Claude, Gemini y Perplexity comenzaron a dominar la cuota de mercado de las consultas informativas, los profesionales del marketing digital entraron en un estado de pánico generalizado. Las métricas de tráfico orgánico tradicional comenzaron a mostrar caídas significativas, y la nueva métrica de vanidad —y de supervivencia comercial— se convirtió en ser citado por un modelo de lenguaje grande (LLM, por sus siglas en inglés). En medio de esta ansiedad colectiva por la visibilidad en la era de la inteligencia artificial, la industria del SEO se volvió desesperadamente receptiva a cualquier nueva táctica, protocolo o estándar que prometiera devolverles el control sobre cómo las máquinas consumían su contenido. Fue en este caldo de cultivo de incertidumbre técnica y miedo a la obsolescencia donde nació una de las propuestas más debatidas y polarizantes de la década: el archivo llms.txt.

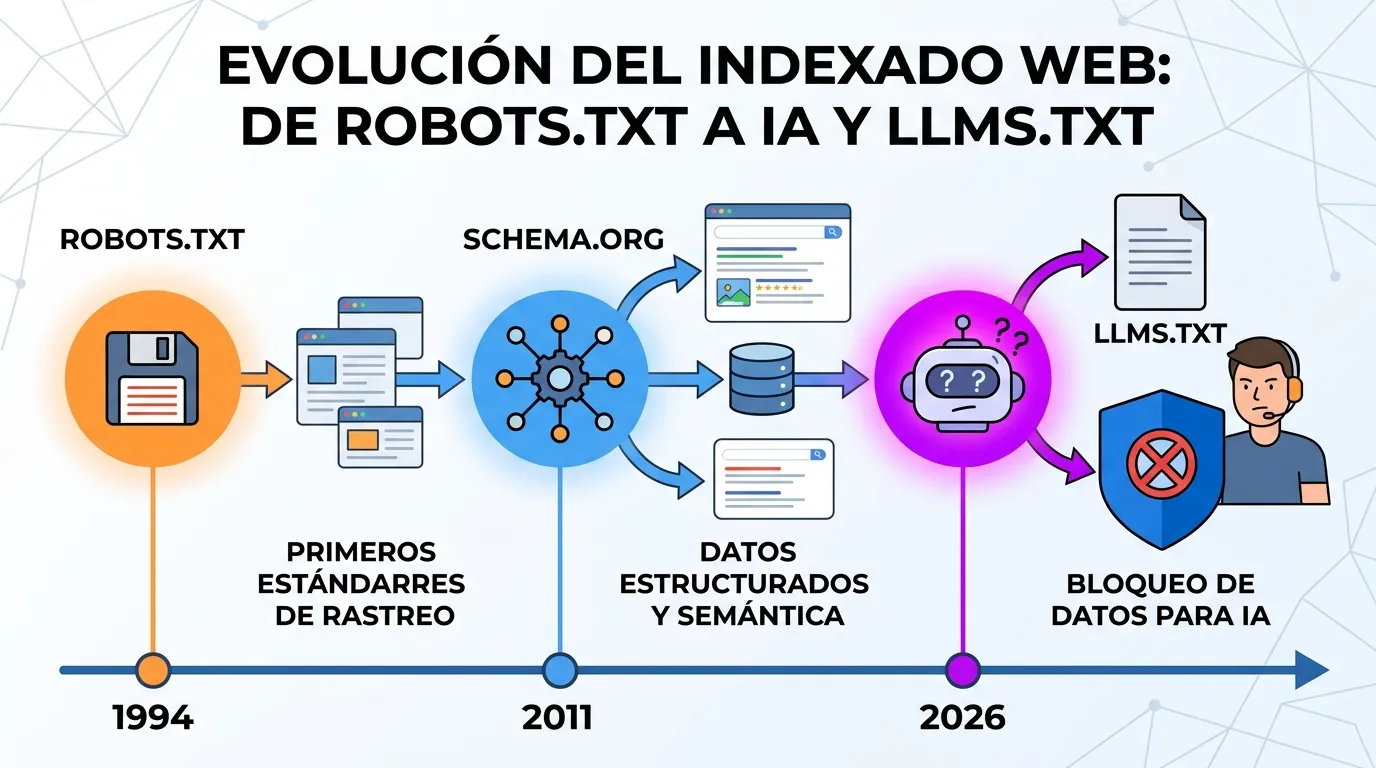

La premisa básica de este archivo parecía tener todo el sentido del mundo desde una perspectiva puramente lógica. Si durante treinta años habíamos utilizado el archivo robots.txt para decirle a los rastreadores web tradicionales por dónde podían y no podían navegar, y habíamos utilizado los archivos sitemap.xml para entregarles un mapa detallado de nuestras URLs, ¿por qué no crear un estándar equivalente diseñado específicamente para los cerebros artificiales de la nueva década? La teoría dictaba que, si le facilitábamos la lectura a las inteligencias artificiales, estas nos recompensarían con citas más frecuentes y mayor prominencia en sus respuestas generadas. Sin embargo, como suele ocurrir en la intersección entre la tecnología emergente y el marketing digital, la distancia entre una propuesta teórica elegante y la adopción real por parte de los gigantes tecnológicos resultó ser un abismo insalvable.

El origen de la propuesta: ¿Qué es exactamente el archivo llms.txt y quién lo inventó?

Para rastrear el momento exacto en que esta tendencia se apoderó de los foros de desarrollo y las agencias de marketing, debemos situarnos en el 3 de septiembre de 2024. Fue en esta fecha cuando Jeremy Howard, una figura inmensamente respetada en la comunidad tecnológica por ser el cofundador de la empresa de inteligencia artificial Answer.AI y del influyente laboratorio de investigación Fast.ai, publicó la propuesta original en el sitio web oficial del proyecto llms.txt. Howard identificó un cuello de botella arquitectónico crítico en la forma en que los modelos de lenguaje intentaban ingerir información de la web pública en tiempo real.

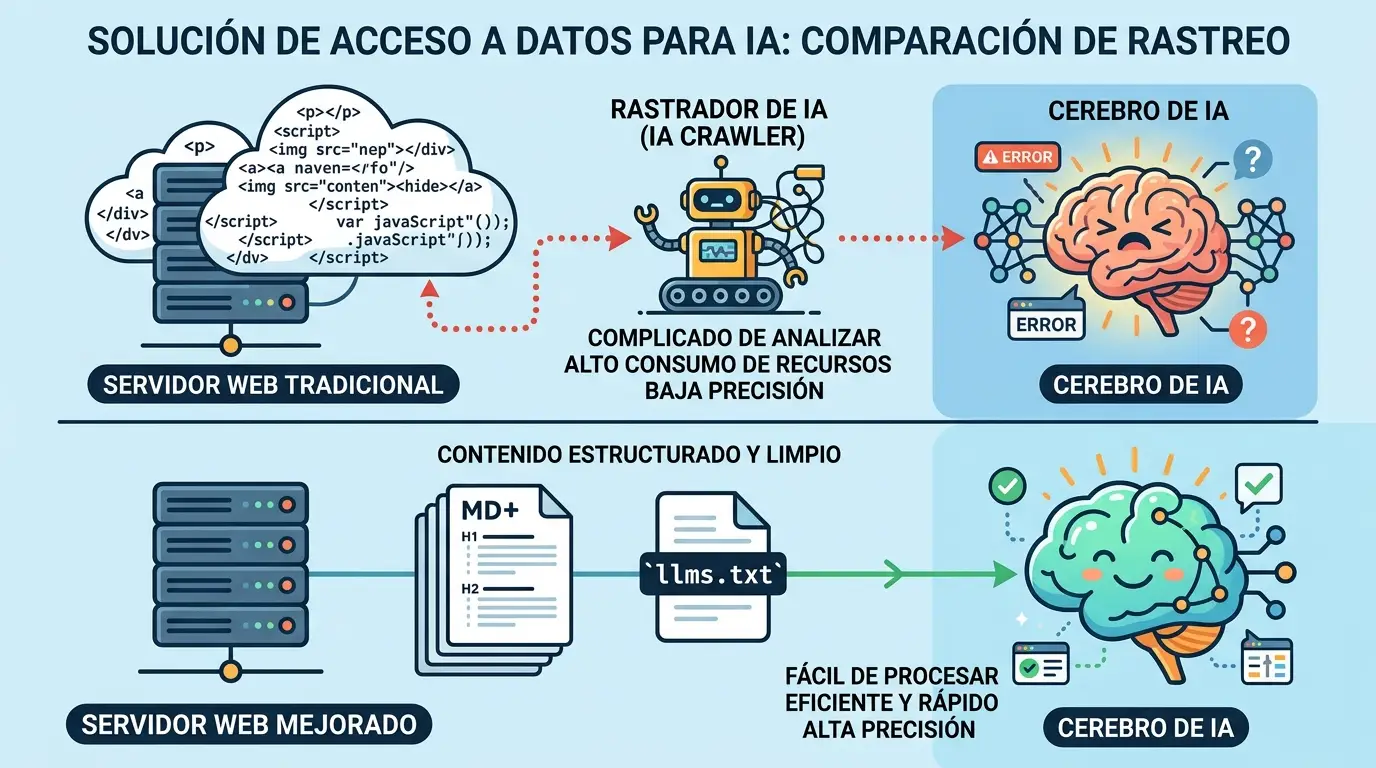

Los modelos de lenguaje grande, a pesar de su asombrosa capacidad para redactar ensayos, resolver problemas matemáticos o depurar código complejo, se enfrentan a un desafío monumental cuando interactúan con la arquitectura web moderna. Un sitio web contemporáneo no es un simple documento de texto plano; es una amalgama hiperactiva de scripts, hojas de estilo en cascada (CSS), menús de navegación redundantes, pies de página interminables, anuncios dinámicos y engorrosos avisos de consentimiento de cookies. Cuando un rastreador impulsado por inteligencia artificial intenta extraer información útil de esta sopa de etiquetas HTML, se enfrenta a lo que los ingenieros denominan “ruido de datos”. Además, los modelos de lenguaje operan bajo estrictas limitaciones financieras y técnicas basadas en los “tokens”, que son las unidades básicas de procesamiento de texto. En 2024 y 2025, extraer el texto puro de una página web cargada de código JavaScript desperdiciaba una cantidad exorbitante de estos tokens simplemente intentando separar el contenido principal del diseño estructural.

La solución propuesta por Howard era de una simplicidad brutal y elegante: los administradores de sitios web debían crear un archivo de texto plano, alojado en el directorio raíz de sus dominios (por ejemplo, midominio.com/llms.txt), escrito enteramente en formato Markdown. Este archivo no pretendía ser un control de acceso ni una directiva restrictiva. A diferencia del histórico robots.txt, que funciona como un guardia de seguridad indicando a los bots qué puertas están cerradas, el llms.txt fue concebido como un guía turístico VIP. Su objetivo era proporcionar a las inteligencias artificiales un índice curado, libre de código espagueti, que enlazara directamente hacia las páginas más ricas en contexto, los tutoriales fundamentales, la documentación de interfaces de programación de aplicaciones (API) y las listas de precios. Todo ello entregado en el lenguaje nativo que los LLMs consumen de manera más eficiente: el texto estructurado con marcado simple.

La anatomía técnica de un puente hacia la inteligencia artificial: Markdown contra HTML

Para comprender por qué la comunidad de desarrolladores se enamoró inicialmente de esta idea, es imperativo analizar la anatomía técnica del archivo propuesto. A diferencia de los complejos esquemas de datos estructurados que requieren un conocimiento profundo de la sintaxis JSON-LD, el archivo llms.txt exigía muy poco esfuerzo técnico. Un webmaster solo necesitaba abrir un editor de texto básico y seguir unas reglas semánticas extremadamente indulgentes.

El estándar dictaba que el archivo debía comenzar obligatoriamente con un encabezado de nivel uno (H1 en HTML, representado por un único símbolo de almohadilla ‘#’ en Markdown) que declarara el nombre del proyecto o del sitio web. Inmediatamente después, se recomendaba incluir un bloque de cita (representado por el símbolo mayor que ‘>’) que proporcionara un resumen conciso y directo sobre el propósito de la organización o el contenido del sitio. A partir de ahí, el archivo se estructuraba en encabezados de menor jerarquía (H2, H3) que categorizaban los enlaces a los recursos clave. La magia residía en que, idealmente, estos enlaces no debían apuntar a las páginas HTML estándar llenas de ruido visual, sino a versiones limpias en Markdown de esas mismas páginas, lo que garantizaba que cuando el modelo de lenguaje siguiera el enlace, encontraría información de alta densidad y cero desperdicio computacional.

El argumento de eficiencia era difícil de rebatir desde la perspectiva de la teoría de la información. Un artículo de blog típico podría pesar cientos de kilobytes una vez que se cargan todos los elementos del Modelo de Objetos del Documento (DOM). Ese mismo artículo, despojado de todo excepto sus encabezados, párrafos y enlaces en formato Markdown, se reducía a unos pocos kilobytes. Para plataformas que procesan miles de millones de peticiones diarias, esta reducción en el tamaño de la carga útil representaba un ahorro teórico masivo en costos de computación de inferencia. Esta narrativa de optimización mutua —”tú me ahorras tokens, yo te doy visibilidad”— fue el motor psicológico que impulsó la adopción inicial. Además, el ecosistema se expandió rápidamente para incluir variaciones como el archivo llms-full.txt, diseñado para sitios web más pequeños que preferían inyectar todo su contenido crítico directamente en un solo archivo masivo, permitiendo a los agentes de inteligencia artificial absorber la totalidad de la entidad comercial en una única petición al servidor.

La fiebre del oro digital de 2025: Adopción masiva, FOMO y promesas de agencias

A lo largo de 2025, el ecosistema digital experimentó lo que retrospectivamente solo puede describirse como una fiebre del oro especulativa en torno a la optimización para motores generativos (GEO, por sus siglas en inglés). Impulsados por el miedo cerval a perder relevancia, las corporaciones, los desarrolladores de software libre y las plataformas de alojamiento web comenzaron a adoptar el estándar no oficial a una velocidad vertiginosa. El punto de inflexión ocurrió cuando gigantes de la infraestructura técnica comenzaron a validar la práctica. Empresas pioneras y profundamente respetadas en el ámbito de la inteligencia artificial, como Anthropic (los creadores de la familia de modelos Claude), publicaron sus propios archivos llms.txt en sus sitios de documentación oficial. Este acto fue interpretado por la industria del SEO no como una experimentación interna, sino como un endoso tácito del formato.

La bola de nieve creció exponencialmente cuando plataformas automatizadas entraron en juego. Mintlify, un popular servicio de alojamiento de documentación técnica, tomó la decisión arquitectónica de generar automáticamente archivos llms.txt para todos y cada uno de los miles de sitios web que operaban en sus servidores. De la noche a la mañana, el volumen de adopción se disparó. Según los datos de seguimiento exhaustivos proporcionados por BuiltWith, para el 25 de octubre de 2025, la asombrosa cifra de 844,473 sitios web activos habían implementado el archivo en sus directorios raíz. La narrativa parecía imparable. Incluso circulaban rumores y documentaciones técnicas experimentales que indicaban que Google había incluido referencias al archivo en su proyecto piloto Agent2Agent (A2A), un protocolo diseñado para facilitar la comunicación entre agentes autónomos en la web.

Naturalmente, donde hay confusión técnica y miedo corporativo, aparece la monetización oportunista. Las agencias de marketing digital y los consultores de SEO comenzaron a empaquetar la creación de archivos llms.txt como un servicio de consultoría premium. Surgieron herramientas de software como servicio (SaaS) que cobraban suscripciones mensuales simplemente por rastrear un sitio web, extraer su contenido, convertirlo a Markdown y mantener actualizado el archivo mágico en el servidor del cliente. Se redactaron innumerables artículos de opinión afirmando que, si una empresa no implementaba este archivo de inmediato, sus productos jamás serían recomendados por los asistentes virtuales del futuro. Sin embargo, en medio de esta cacofonía de implementaciones y promesas de tráfico infinito, un detalle absolutamente fundamental estaba siendo ignorado de manera sistemática por casi toda la industria: ninguna de las principales empresas desarrolladoras de modelos de lenguaje grande había confirmado oficialmente que sus sistemas estuvieran programados para buscar, leer o priorizar el contenido de estos archivos.

El choque con la realidad en 2026: Lo que revelan los datos empíricos

A medida que el calendario avanzaba hacia el año 2026, la luna de miel especulativa comenzó a disiparse frente al escrutinio implacable del método científico y el análisis de datos a gran escala. Las promesas teóricas tuvieron que enfrentarse a los registros de los servidores y a los rastreadores de visibilidad empíricos. Fue entonces cuando la narrativa de que el llms.txt era la clave maestra para dominar la inteligencia artificial colapsó bajo el peso de la evidencia empírica irrefutable.

Uno de los golpes más devastadores a la credibilidad del estándar provino de un análisis meticuloso realizado por la firma de inteligencia de búsqueda ALLMO en enero de 2026. Sus investigadores se plantearon una pregunta directa y carente de sentimentalismos: si el archivo realmente proporciona una ventaja competitiva, los dominios que lo han implementado deberían tener una presencia desproporcionadamente alta en las citas generadas por las inteligencias artificiales. Para probar esta hipótesis, auditaron una colosal base de datos patentada. El resultado fue un contundente balde de agua fría para los evangelistas del formato. De hecho, fue catalogado como sólo 1 de los 50 dominios más citados en la búsqueda por inteligencia artificial posee un archivo llms.txt

, según Niclas Aunin en el estudio LLMs.txt for AI Search Report 2026 de ALLMO. El único dominio destacado que lo poseía era Target.com. De manera aún más reveladora, corporaciones de escala masiva como Walmart, que habían experimentado publicando el archivo a finales de 2025, lo eliminaron silenciosamente de sus servidores a principios de 2026 tras constatar su inutilidad táctica.

Esta falta de correlación fue respaldada por investigaciones paralelas de otras autoridades de la industria. SE Ranking ejecutó un rastreo masivo que analizó 300,000 dominios comerciales y descubrió que, si bien la adopción rondaba el 10.13%, estaba peligrosamente sesgada hacia sitios web de bajo tráfico y baja autoridad, cuyos administradores buscaban desesperadamente atajos para ganar visibilidad. Los dominios corporativos de alta autoridad, dotados de inmensos presupuestos de ingeniería y equipos de SEO de vanguardia, habían evaluado la tecnología y decidido ignorarla por completo, dedicando sus recursos a tácticas con retorno de inversión comprobable.

El veredicto final sobre la futilidad del esfuerzo provino de las propias voces autorizadas que analizan las tripas de los motores de búsqueda. Ryan Law, Director de Marketing de Contenidos en Ahrefs, destruyó la ilusión colectiva al evaluar la herramienta desde una perspectiva de infraestructura web. El archivo fue descrito implacablemente como una solución en busca de un problema

, según Ryan Law en el estudio What Is llms.txt, and Should You Care About It?. Su argumento central era irrefutable: los motores de búsqueda contemporáneos y los rastreadores de inteligencia artificial ya poseen infraestructuras masivas, altamente eficientes y probadas durante décadas (como los sitemaps XML y el renderizado avanzado de JavaScript) para ingerir contenido. No necesitan que los webmasters reescriban sus sitios web en Markdown. Para poner el último clavo en el ataúd, John Mueller, el reconocido portavoz de la Búsqueda de Google, intervino en las discusiones de la comunidad para aclarar definitivamente la postura del gigante de Mountain View. Al referirse a las especulaciones sobre si las plataformas de inteligencia artificial leían el archivo, su respuesta fue lapidaria: AFAIK none of the AI services have said they’re using LLMs.TXT (and you can tell when you look at your server logs that they don’t even check for it)

, según John Mueller en el foro público de Reddit.

| Estudio / Entidad | Muestra analizada | Tasa de adopción observada | Impacto empírico en visibilidad IA |

|---|---|---|---|

| ALLMO.ai (Enero 2026) | 94,000 URLs citadas / 11,000 respuestas de IA | 1 de los 50 dominios más citados (2%) | Nulo. Sin ventaja estadística demostrable. |

| SE Ranking (2026) | 300,000 dominios comerciales | 10.13% | Inexistente. Adopción concentrada en sitios de bajo tráfico. |

| Ahrefs (Marzo 2026) | Análisis de infraestructura y logs de servidores | Creciente en nichos de desarrollo (DevTools) | Cero. Los principales proveedores de LLM no soportan el protocolo. |

La resistencia de los desarrolladores: El caso del plugin The SEO Framework

En el vertiginoso mundo del desarrollo web y la gestión de contenidos, los creadores de software a menudo se ven obligados a actuar como la última línea de defensa racional frente a la histeria colectiva y las modas pasajeras. En el ecosistema de WordPress, que alimenta a casi la mitad de los sitios web de internet, los desarrolladores de plugins de SEO dictan qué fragmentos de código, metadatos y archivos se generan para millones de usuarios. Cuando una nueva tendencia asoma en el horizonte, la presión de la comunidad de usuarios para que se añada un “botón mágico” que solucione sus problemas de tráfico es abrumadora. Un ejemplo fascinante y sumamente instructivo de esta dinámica de resistencia frente al espejismo tecnológico se documentó públicamente en los repositorios de código abierto, específicamente en el caso del respetado y ligero plugin The SEO Framework.

A medida que la presión mediática en torno al archivo de texto para inteligencias artificiales alcanzaba su punto álgido, los usuarios comenzaron a abrir hilos de peticiones formales exigiendo que el plugin integrara una función para generar y mantener automáticamente este archivo, replicando el comportamiento que ya tienen para los mapas de sitio tradicionales. La respuesta del desarrollador principal, conocido en la comunidad como Sybrew, registrada en el hilo de incidencias de GitHub (issue #732), constituye una lección magistral de higiene de software, prudencia arquitectónica y profundo conocimiento de cómo funciona realmente la infraestructura de internet.

La filosofía detrás de esta negativa categórica se basaba en la protección contra el temido “bloatware” (software inflado con características innecesarias). Para un desarrollador de sistemas a gran escala, añadir una nueva característica no es simplemente insertar unas pocas líneas de código. Implica diseñar interfaces de usuario, establecer consultas a bases de datos estructuradas, consumir memoria RAM del servidor para la generación dinámica de archivos de texto en Markdown, y comprometerse a mantener esa lógica de código durante años frente a posibles fallos de seguridad o actualizaciones del núcleo del gestor de contenidos. Exigir que los servidores web asuman esta carga computacional y de almacenamiento para satisfacer un estándar no oficial, especulativo y explícitamente ignorado por entidades como Google y OpenAI, es una violación fundamental de las mejores prácticas de ingeniería de software.

El argumento de los desarrolladores puristas se sostiene en una verdad incómoda para los profesionales del marketing: los rastreadores de inteligencia artificial (como GPTBot, ClaudeBot o Google-Extended) son, en su nivel más fundamental, sofisticados programas de extracción de datos que operan sobre las inmensas tuberías de red de internet. Estos rastreadores ya son perfectamente capaces de interpretar el Document Object Model (DOM) tradicional, purgar las etiquetas innecesarias internamente usando inmensos clústeres de servidores en la nube, y extraer el texto semántico. La idea de que los propietarios de pequeños sitios web deban asumir la responsabilidad de pre-procesar su contenido para ahorrarle milisegundos de cómputo a corporaciones billonarias resulta, desde una perspectiva de arquitectura de sistemas, profundamente defectuosa y desequilibrada.

El veredicto final de Google y la verdadera optimización para motores generativos (GEO) en 2026

Si la evidencia empírica, las confirmaciones oficiales de los portavoces de búsqueda y el rechazo frontal de los arquitectos de software han dejado claro que la implementación de este peculiar archivo de texto plano no proporciona beneficios tangibles, surge la pregunta inevitable: ¿cómo se supone que los creadores de contenido y las empresas deben adaptar sus estrategias para la era de la inteligencia artificial? La respuesta no reside en adoptar atajos experimentales o perseguir estándares no avalados, sino en redoblar los esfuerzos sobre las fundaciones técnicas y cualitativas de la web semántica, una disciplina que ha estado madurando de manera silenciosa pero constante durante los últimos quince años.

En el año 2026, la verdadera Optimización para Motores Generativos (GEO) se fundamenta innegablemente en la estructuración de datos estandarizada internacionalmente. El vocabulario Schema.org, respaldado por consorcios formales y gigantes de la tecnología, sigue siendo el idioma universal que las máquinas entienden a la perfección. En lugar de crear un archivo huérfano con resúmenes manuales, las arquitecturas web modernas inyectan microdatos JSON-LD directamente en el código de la página. Cuando un rastreador de inteligencia artificial ingiere una página, el Schema.org le informa con precisión matemática si está leyendo un artículo de investigación, la página de un producto con un precio específico y disponibilidad de inventario, o una sección de preguntas frecuentes (FAQ). Esta estandarización elimina cualquier ambigüedad inferencial, permitiendo a los modelos de lenguaje utilizar la información con altos grados de confianza matemática, que es exactamente lo que buscan al generar respuestas fundamentadas para los usuarios.

Además de la infraestructura de datos estructurados, los modelos de lenguaje del presente están obsesionados con las señales de autoridad y confianza. El marco conceptual E-E-A-T (Experiencia, Conocimiento, Autoridad y Confiabilidad), promovido intensamente por Google, se ha convertido en el filtro primario a través del cual las inteligencias artificiales deciden qué fuentes merecen ser citadas y cuáles deben ser relegadas a la irrelevancia. Un modelo de lenguaje no citará una afirmación médica o un análisis financiero simplemente porque el texto fue servido limpiamente en formato Markdown; lo citará porque la entidad comercial que publica la información posee una reputación digital verificable, un historial histórico de precisión de datos y es referenciada consistentemente por otros dominios de alta autoridad académica o periodística en la web abierta.

Por otro lado, la evolución hacia un ecosistema digital gobernado por la interacción máquina a máquina no se basa en el raspado de texto plano, sino en la integración directa mediante Interfaces de Programación de Aplicaciones (API). Las corporaciones más astutas del momento no están redactando largos manifiestos en sus directorios raíz; están abriendo puntos finales de acceso de datos seguros y en tiempo real, permitiendo que los agentes autónomos consulten inventarios y normativas de manera determinista y estructurada. Frente a esta sofisticación arquitectónica masiva, la confianza depositada en un simple archivo de texto con enlaces básicos resulta ser una reliquia conceptual de una época donde se subestimaba profundamente la capacidad técnica de los sistemas de inteligencia artificial modernos.