Si echamos la vista atrás, al caluroso agosto de 2025, recordaremos un fenómeno que sacudió los cimientos de la generación de imágenes por inteligencia artificial. No fue un lanzamiento solemne ni una conferencia académica aburrida; fue la llegada de Nano Banana. Lo que comenzó como un nombre en clave casi cómico para el modelo Gemini 2.5 Flash Image de Google, se convirtió rápidamente en un estándar de la industria, acumulando, según datos de la propia compañía, más de 13 millones de usuarios en apenas cuatro días.

Hoy, 27 de febrero de 2026, Google ha decidido retirar el velo de su sucesor directo: Nano Banana 2. En la redacción de Crónicatech, hemos pasado las últimas horas analizando documentación técnica, probando la API y leyendo los informes de Google DeepMind para traeros este análisis exhaustivo. No estamos ante una simple actualización incremental; estamos ante la fusión definitiva entre la velocidad absurda de los modelos “Flash” y la calidad visual que antes solo estaba reservada para las versiones “Pro”.

El contexto histórico: del caos de 2025 a la precisión de 2026

Para entender por qué Nano Banana 2 es importante, primero debemos entender el problema que viene a resolver. Durante 2024 y 2025, los creadores de contenido se enfrentaban a una dicotomía frustrante. Podían elegir modelos rápidos (como el Nano Banana original o versiones turbo de la competencia) que generaban imágenes en segundos pero con una calidad de “borrador”, o podían optar por modelos pesados que tardaban hasta un minuto en renderizar pero ofrecían detalles fotorealistas.

El primer Nano Banana democratizó la creación de imágenes rápidas. Fue el motor detrás de millones de memes y bocetos rápidos. Sin embargo, tenía carencias notables: el texto era ilegible (escribir un cartel era una misión imposible), las manos seguían siendo una pesadilla ocasional y la resolución nativa rara vez superaba los 1024×1024 píxeles sin perder coherencia.

Con el lanzamiento de hoy, Google promete haber cerrado esa brecha. Según el comunicado oficial en el blog de Google, Nano Banana 2 (técnicamente Gemini 3.1 Flash Image) no solo iguala la calidad de su predecesor “Pro”, sino que lo hace manteniendo la latencia ultrabaja que hizo famosa a la marca. Es el equivalente tecnológico a tener un coche de Fórmula 1 con el confort de una limusina de lujo.

¿Qué es exactamente Nano Banana 2? Desgranando la tecnología

Nano Banana 2 es un modelo de difusión latente optimizado que opera bajo la arquitectura Gemini 3.1. A diferencia de los modelos de 2024 que requerían “prompts” (instrucciones) extremadamente técnicos y llenos de palabras clave como “4k, unreal engine, octane render”, Nano Banana 2 ha sido entrenado para entender el lenguaje natural con una precisión casi humana. Esto se debe a su integración profunda con el modelo de lenguaje Gemini; el sistema “razona” sobre tu petición antes de empezar a dibujar.

Características clave y novedades técnicas

Las mejoras no son solo estéticas, son estructurales. A continuación, desglosamos las cuatro novedades que, en nuestra opinión, redefinen el mercado en 2026:

- Resolución Nativa y Escalado 4K: Mientras que la versión anterior sufría al intentar generar imágenes grandes, Nano Banana 2 soporta nativamente resoluciones de hasta 2K y utiliza un sistema de escalado inteligente (upscaling) para llegar a 4K sin añadir los típicos “artefactos” o ruido digital. Esto lo hace apto para impresión profesional, algo impensable hace solo un año en modelos “Flash”.

- Consistencia de Personajes (El Santo Grial): Quizás la característica más demandada por los novelistas gráficos y diseñadores de storyboard. El nuevo modelo permite mantener la identidad de hasta 5 personajes diferentes y 14 objetos dentro de un mismo flujo de trabajo. Si generas a un “astronauta con una cicatriz en la ceja izquierda”, ese astronauta mantendrá la cicatriz y sus rasgos faciales exactos en la siguiente imagen, aunque cambies el ángulo de la cámara o la iluminación.

- Renderizado de Texto Perfecto: Olvídate de los garabatos alienígenas. Nano Banana 2 utiliza un motor de atención dedicado al texto. Si le pides un letrero que diga “Oferta Especial en Crónica Tech”, el modelo generará exactamente esas letras, en el orden correcto y con la tipografía adecuada. Esto supone un golpe directo a herramientas de diseño gráfico tradicionales como Canva o Adobe Express.

- Grounding con Google Search: Esta es una novedad exclusiva del ecosistema de Google. El modelo puede conectarse en tiempo real a la Búsqueda de Google para verificar datos visuales. Si le pides una imagen de un “coche específico modelo 2026 que acaba de salir ayer”, el modelo no alucinará un coche genérico; buscará referencias visuales reales y generará una imagen precisa basada en la realidad actual.

Según explica Naina Raisinghani, Product Manager en Google DeepMind, esta capacidad de “grounding” (anclaje a la realidad) permite al modelo crear infografías y diagramas basados en datos reales, transformando notas abstractas en visualizaciones precisas.

Nano Banana 1 vs. Nano Banana 2: el salto evolutivo

Para nuestros lectores más técnicos, hemos preparado una comparativa directa basada en los datos proporcionados por plataformas de análisis como Fal.ai y los reportes de rendimiento de la comunidad de desarrolladores.

| Característica | Nano Banana 1 (v1) | Nano Banana 2 (v2) |

|---|---|---|

| Arquitectura | Gemini 3.0 Flash Image | Gemini 3.1 Flash Image |

| Resolución Máxima | 1024×1024 (aprox. 1K) | Nativo 2K / Escalado a 4K |

| Texto en imagen | Errores ocasionales | Legible y preciso (OCR-ready) |

| Consistencia | Aleatoria entre generaciones | Hasta 5 personajes y 14 objetos fijos |

| Conocimiento del Mundo | Congelado en fecha de corte | Actualizado (vía Google Search) |

| Profundidad de Color | Estándar (8-bit) | Profunda (16-bit) |

La diferencia fundamental radica en el “cerebro” detrás del pincel. Nano Banana 1 era un excelente imitador de patrones visuales. Veía ruido y encontraba formas. Nano Banana 2, en cambio, entiende la física y la lógica de la escena. Sabe que si hay un espejo, el reflejo debe ser inverso; sabe que si hay texto, debe ser legible. Es el paso de la pareidolia digital a la comprensión semántica.

Zona de experimentos: poniendo a prueba el modelo

En Crónica Tech creemos que la mejor forma de entender la tecnología es probándola. No nos conformamos con la nota de prensa. Hemos diseñado tres experimentos conceptuales. A continuación, presentamos los prompts (instrucciones) exactos que hemos diseñado para estresar las capacidades del nuevo modelo frente a su predecesor. Si tienes acceso a la API de Gemini o a Google AI Studio, los invitamos a replicar estos tests.

Experimento 1: la prueba del texto y la neon-noir

El talón de Aquiles de la IA generativa siempre ha sido escribir. Nano Banana 1 solía generar símbolos que parecían una mezcla de cirílico y jeroglíficos egipcios. Con este prompt, buscamos verificar la precisión tipográfica y la gestión de luces complejas.

Prompt:

“Una fotografía cinematográfica con lente de 35mm a nivel de calle en una ciudad cyberpunk lluviosa de noche. En el centro, un letrero de neón brillante y ligeramente parpadeante donde se lee claramente ‘CRÓNICA TECH 2026’ en letras azules cian. Debajo, un subtexto más pequeño en neón rosa que dice ‘ANÁLISIS EN VIVO’. El reflejo de las letras debe verse correctamente distorsionado en los charcos del suelo asfáltico húmedo.”

Experimento 2: consistencia narrativa y lógica espacial

Mantener a un personaje idéntico en situaciones distintas es vital para contar historias. También queremos probar si el modelo entiende instrucciones de posición complejas.

Prompt:

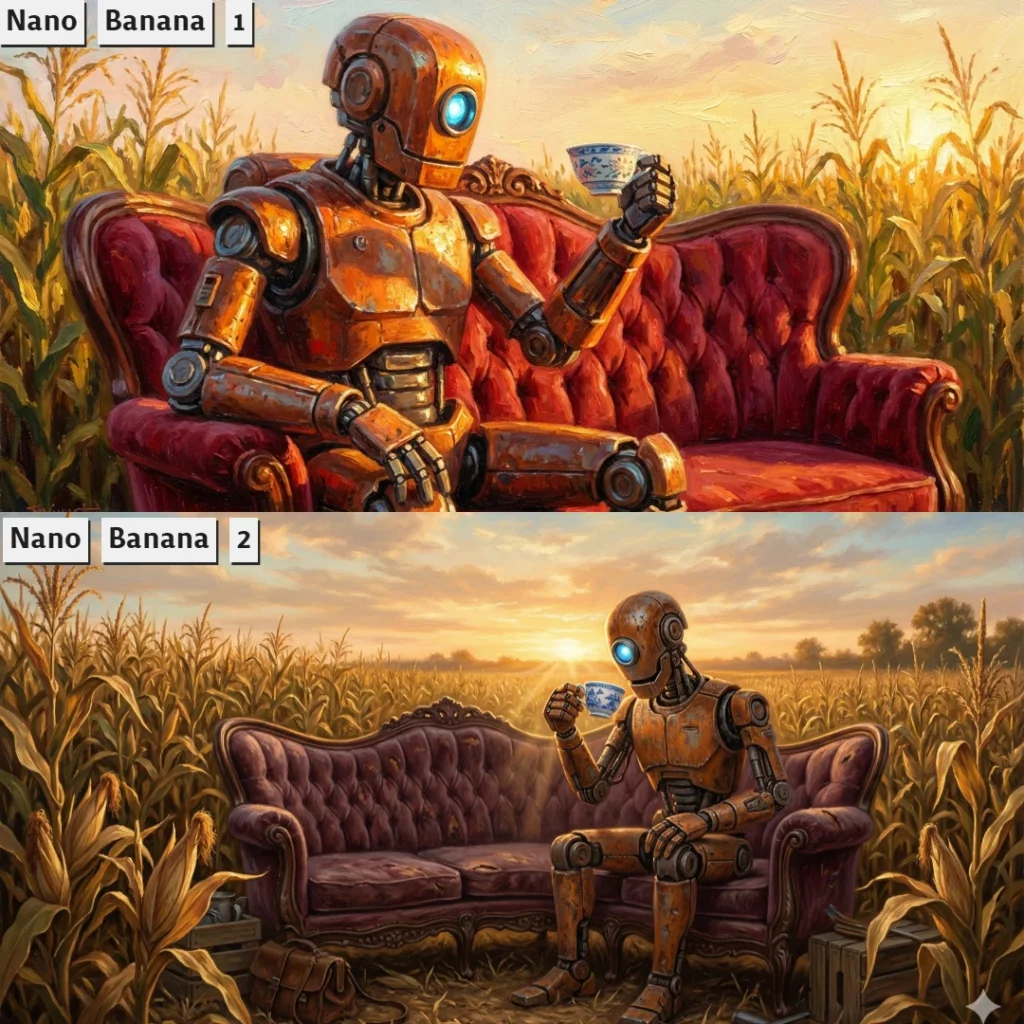

“Un personaje recurrente: un explorador robótico llamado ‘Unit-7’ que tiene el cuerpo de metal oxidado color naranja y una sola lente azul brillante como ojo. Escena: Unit-7 está sentado en un antiguo sofá de terciopelo victoriano en medio de un campo de maíz. El robot sostiene delicadamente una taza de té de porcelana china con su mano mecánica derecha, mirándola con curiosidad. Iluminación de atardecer dorado, estilo pintura al óleo detallada.”

Experimento 3: El desafío del fotorealismo y la textura

Finalmente, la prueba de fuego: la piel humana y las texturas imperfecciones. Los modelos antiguos tienden a crear pieles de “plástico” o “cera”.

Prompt para copiar:

“Retrato en primerísimo primer plano (macro) del ojo de una persona anciana. Enfoque nítido en el iris color miel, mostrando cada detalle y textura. Se deben apreciar las arrugas de la piel con poros realistas, no suavizados. Iluminación lateral dramática tipo Rembrandt que resalta la textura de la piel. Resolución 8k, fotografía RAW, sin filtros de belleza.”

¿El fin de la competencia?

Nano Banana 2 ya está disponible globalmente a partir de hoy. Los usuarios pueden encontrarlo integrado en la aplicación de Gemini (sustituyendo al modelo Pro en muchos niveles de suscripción), en Google Search a través de la pestaña de imágenes generativas, y para desarrolladores a través de Vertex AI y Google AI Studio.

Según informes de medios especializados como Mashable, este lanzamiento pone a Google en una posición de ventaja agresiva frente a competidores como Midjourney v6 o las variantes de Stable Diffusion. La clave no es solo la calidad, sino la integración. Al estar dentro del buscador y de las herramientas de oficina de Google Workspace, Nano Banana 2 deja de ser un juguete para curiosos y se convierte en una herramienta de productividad masiva.

Estamos ante la evolución del pincel. Nano Banana 2 no imagina por ti; ejecuta tu imaginación con una fidelidad que, hasta ayer, era ciencia ficción. La pregunta ya no es si la IA puede dibujar, sino qué vas a pedirle tú que dibuje.