La conferencia Google Cloud Next 2024 ha sido el escenario para una serie de innovaciones en el ámbito de la inteligencia artificial (IA).

En el ámbito del desarrollo, Google ha presentado la nueva actualización de Gemini Code Assist, una herramienta que no solo ha demostrado mejorar significativamente la eficiencia de los desarrolladores internos de Google, sino que también ha mostrado resultados positivos en el uso externo, optimizando la creación de código en múltiples plataformas y entornos de desarrollo. Este avance se complementa con Gemini Cloud Assist, que ofrece asistencia continua a lo largo del ciclo de vida de las aplicaciones.

En términos de infraestructura, Google ha reforzado su oferta con la AI Hypercomputer, una arquitectura avanzada que aprovecha lo último en TPUs y GPUs para proporcionar una formación de modelos de IA más eficiente y económica. Las mejoras anunciadas en almacenamiento y procesamiento prometen acelerar aún más el rendimiento y la gestión de los modelos de IA, facilitando operaciones más complejas y a mayor escala.

Lee también: Google Cloud Next 2023: todos los anuncios y novedades

Además, Vertex AI se posiciona como una plataforma revolucionaria para la creación y gestión de modelos de IA, ofreciendo una gama ampliada de más de 130 modelos que abren nuevas posibilidades en la personalización y aplicación de la inteligencia artificial en negocios y servicios. La integración de esta tecnología en BigQuery y otros servicios de Google Cloud apunta a una mayor sinergia entre los datos y la IA, permitiendo a las empresas extraer un valor sin precedentes de sus informaciones.

Asistencia de desarrollo con Gemini

Gemini Code Assist, una herramienta de asistencia de código basada en inteligencia artificial desarrollada para organizaciones, ha sido implementada para un grupo selecto de desarrolladores en Google. Según informes internos, estos desarrolladores han logrado reducir en un 40% el tiempo necesario para completar tareas comunes de desarrollo y han disminuido en un 55% el tiempo empleado en la escritura de nuevo código. La herramienta también ha mostrado resultados positivos con clientes externos, como Quantiphi, que reportó un incremento en la productividad de sus desarrolladores de más del 30%.

Gemini Code Assist ahora es compatible con bases de código privadas, permitiendo su uso en diferentes entornos como instalaciones locales, GitHub, GitLab, Bitbucket, entre otros. Los anuncios recientes apuntan a fortalecer la posición de liderazgo de la empresa en el mercado de desarrollo de software:

Gemini 1.5 Pro en Gemini Code Assist: esta nueva actualización, actualmente en fase de prueba privada, cuenta con una amplia ventana de contexto de 1 millón de tokens, lo que promete mejorar la codificación en proyectos de gran envergadura. La herramienta ahora ofrece sugerencias de código más precisas, proporciona información más detallada y mejora los flujos de trabajo.

Gemini Cloud Assist: esta función proporciona asistencia de IA a lo largo de todo el ciclo de vida de las aplicaciones, facilitando aspectos como el diseño, la seguridad, la operatividad, la solución de problemas, y la optimización del rendimiento y costos de las aplicaciones.

Mejoras en infraestructura para IA

El potencial de la inteligencia artificial generativa para acelerar la transformación en empresas, gobiernos y consumidores depende significativamente de la infraestructura tecnológica que la soporta. Google Cloud ha reforzado su oferta con la AI Hypercomputer, una arquitectura que combina TPUs y GPUs avanzados, junto con software de inteligencia artificial, para proporcionar una manera eficiente y costeable de entrenar y mantener modelos de IA.

Recientemente, Google Cloud ha anunciado varias mejoras para reforzar su liderazgo en el sector:

A3 Mega: Desarrollada en colaboración con NVIDIA y utilizando GPUs H100, esta nueva instancia GPU-based está ahora disponible generalmente y ofrece el doble de ancho de banda por GPU comparado con las instancias A3 anteriores, para soportar las cargas de trabajo más exigentes. Además, se ha lanzado Confidential A3, que permite a los clientes proteger mejor la confidencialidad e integridad de los datos privados y las cargas de trabajo de IA durante la capacitación y la inferencia.

NVIDIA B200 y GB200 NVL72: Los chips Grace Blackwell más recientes de NVIDIA estarán disponibles en Google Cloud a principios de 2025 en dos variantes: B200, diseñado para capacitación y soporte convencional, y GB200 NVL72, enfocado en la capacitación y soporte de modelos de vanguardia.

TPU v5p: Se ha anunciado la disponibilidad general de TPU v5p, el acelerador de IA más potente, escalable y flexible de Google para entrenamiento e inferencia, que ofrece cuatro veces la potencia de cómputo por módulo comparado con la generación anterior. También se ha extendido la compatibilidad con Google Kubernetes Engine (GKE) para TPU v5p. El uso de GPUs y TPUs en GKE ha aumentado más del 900% en el último año.

Opciones de almacenamiento optimizadas con IA: Google ha mejorado la velocidad de entrenamiento con nuevas funciones de almacenamiento en caché en Cloud Storage FUSE y Parallelstore, que acercan los datos a la TPU o GPU del cliente. También se ha introducido Hyperdisk ML (en versión preview), un servicio de almacenamiento en bloques de próxima generación que acelera los tiempos de carga de modelos hasta 3.7 veces en comparación con las alternativas habituales.

Nuevas opciones para Dynamic Workload Scheduler: Se ha añadido el modo Calendario para garantizar la hora de inicio y el inicio flexible para una optimización de costos, ayudando a los clientes a gestionar eficientemente los recursos para la distribución de trabajos complejos de capacitación e inferencia.

Google también está llevando la IA más cerca de los lugares donde se generan y consumen los datos, incluyendo entornos edge, air-gapped, Google Sovereign Clouds y cross-cloud, a través de Google Distributed Cloud (GDC), que permite elegir el entorno y los controles que mejor se adapten a las necesidades específicas de cada organización. Por ejemplo, el operador de telefonía móvil Orange utiliza la IA en GDC para mejorar el rendimiento de la red y la experiencia del cliente en 26 países.

Se han anunciado nuevas capacidades en GDC, incluyendo:

GPUs NVIDIA para GDC: Se han integrado GPUs NVIDIA tanto para configuraciones conectadas como air-gapped, cada una de ellas admitirá nuevas instancias GPU-based para ejecutar modelos de IA de manera eficiente.

GKE en GDC: La misma tecnología de GKE utilizada por las principales empresas de inteligencia artificial en Google Cloud ahora estará disponible en GDC.

Soporte de modelos de IA: Se están habilitando una variedad de modelos abiertos de IA, incluyendo Gemma y Llama 2, para ejecutarse en entornos conectados edge y air-gapped.

AlloyDB Omni para Vector Search: También se ofrece el poder de AlloyDB Omni para Vector Search, permitiendo la búsqueda y recuperación de información en GDC para datos privados y confidenciales con una latencia extremadamente baja.

Nube soberana: Para cumplir con los requisitos regulatorios más estrictos, se ofrece GDC en una configuración completamente air-gapped con operaciones locales, administrada por Google o a través de un socio seleccionado por el cliente, ofreciendo control total y flexibilidad para responder rápidamente a los cambios en las regulaciones.

Además, Google ha anunciado la introducción de nuevas opciones informáticas de uso general para ayudar a los clientes a maximizar el rendimiento, permitir la interoperabilidad entre aplicaciones y cumplir con objetivos de sostenibilidad, mientras reducen costos. Esto incluye Google Axion, la primera CPU personalizada basada en Arm diseñada para centros de datos, que ofrece hasta un 50% mejor rendimiento y hasta un 60% mejor eficiencia energética que las instancias x86-based de la generación actual.

También se han anunciado N4 y C4, dos nuevas series de máquinas virtuales en el portafolio de uso general; máquinas Bare-Metal en la familia de máquinas C3; la disponibilidad de nuevas capacidades para optimizar las operaciones de red y mejorar la seguridad, y una serie de otras mejoras diseñadas para apoyar a las empresas en la optimización de sus operaciones en la nube.

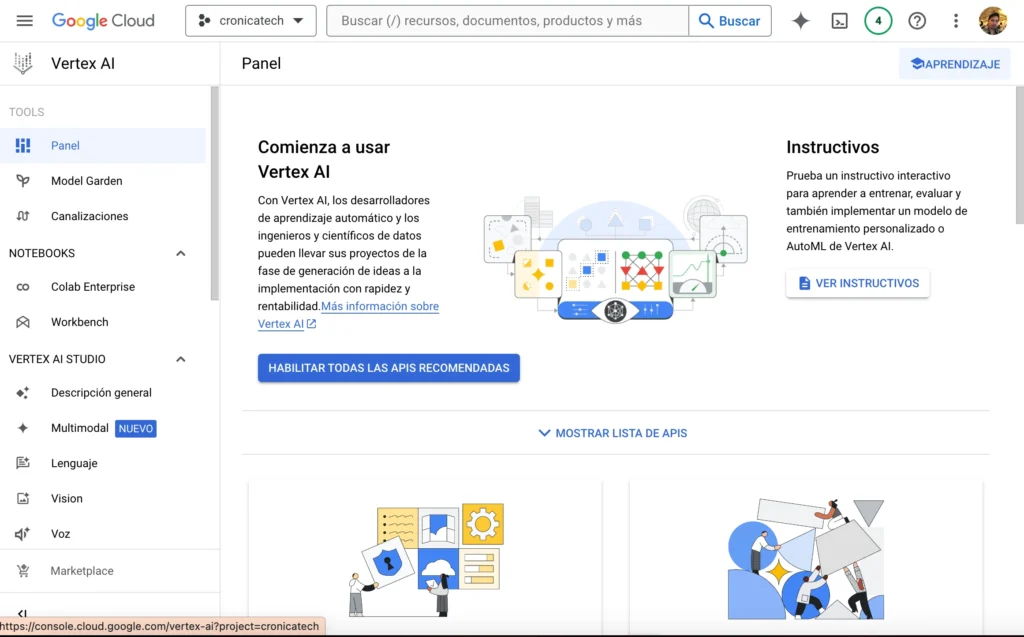

Creación de agentes con Vertex AI

Vertex AI permite a los clientes explorar, personalizar, expandir, implementar y administrar modelos de inteligencia artificial generativa. Actualmente, ofrece más de 130 modelos, incluyendo las últimas versiones de Gemini, modelos de socios como Claude 3 y modelos abiertos populares como Gemma, Llama 2 y Mistral. Recientemente, Google ha ampliado el acceso a una diversa selección de modelos, ofreciendo a los usuarios una amplia variedad de opciones:

Gemini 1.5 Pro: Este modelo ofrece ventanas contextuales de 128 mil tokens y 1 millón de tokens y ahora está disponible en versión public preview. Además, se ha introducido la capacidad de procesar archivos de audio, incluidos videos con audio, permitiendo a los clientes manejar grandes volúmenes de información en una única secuencia, incluyendo una hora de vídeo o 11 horas de audio, así como bases de código de más de 30 mil líneas o más de 700 mil palabras.

Claude 3: La nueva familia de modelos de última generación de Anthropic está ahora disponible de manera general para los clientes en Vertex AI.

CodeGemma: Gemma es una familia de modelos abiertos y livianos de última generación que utiliza la misma investigación y tecnología que los modelos Gemini. Una versión optimizada de Gemma, diseñada para la generación y asistencia de código, CodeGemma, ahora también está disponible en Vertex AI.

Imagen 2.0: Esta tecnología avanzada de conversión de texto a imagen incluye una variedad de funciones para la generación de imágenes, ayudando a las empresas a crear imágenes que se alineen con los requisitos específicos de su marca. Recientemente, se ha añadido la capacidad de convertir texto en imágenes animadas, como gifs, que incluyen filtros de seguridad y marcas de agua digitales. También se ha anunciado la disponibilidad general de capacidades avanzadas de edición de fotografías, que incluyen técnicas de inpainting y outpainting.

Marca de agua digital: Con la tecnología SynthID de Google DeepMind, Google ha anunciado la disponibilidad general de esta funcionalidad para imágenes generadas por IA producidas por Imagen 2.0.

Vertex AI también permite a los usuarios personalizar el modelo de base seleccionado con sus propios datos, ofreciendo diversas técnicas como ajuste fino de modelos, Reinforcement Learning from Human Feedback (RLHF), distilling, técnicas supervised y adapter-based tuning como Low Rank Adaption (LORA). Recientemente, se ha anunciado la compatibilidad con técnicas supervised y adapter-based tuning para personalizar los modelos Gemini de manera más eficiente y económica.

Los clientes pueden expandir y enriquecer sus modelos con datos específicos de su organización a través de herramientas administradas para extensiones, llamadas a funciones y grounding. Además, Retrieval Augmented Generation (RAG) conecta el modelo a los sistemas empresariales para recuperar información y tomar medidas, permitiendo obtener datos de productos y facturación en tiempo real, actualizar la información de contacto o las suscripciones de los clientes, o incluso completar transacciones. Hoy, se han expandido las capacidades de grounding de Vertex AI de dos nuevas maneras:

Búsqueda de Google: Los modelos de grounding en Google Search combinan el poder de los modelos básicos de Google con acceso a información reciente y de alta calidad para mejorar significativamente la integridad y precisión de las respuestas.

Tus propios datos: Permite a los agentes grounding utilizar datos de aplicaciones empresariales como Workday o Salesforce, o información almacenada en bases de datos de Google Cloud como AlloyDB y BigQuery.

Además, Vertex AI facilita la implementación, administración y monitoreo de modelos con nuevas herramientas y capacidades, incluyendo herramientas de gestión de prompts para colaborar en prompts predefinidos con notas y estados, AutoSxS que proporciona explicaciones sobre la superioridad de una respuesta sobre otra y ofrece puntuaciones de certeza, y la función Rapid Evaluation, que ahora en versión preview, ayuda a evaluar rápidamente modelos en conjuntos de datos más pequeños.

Vertex AI Agent Builder integra modelos básicos, Google Search y otras herramientas de desarrollo para facilitar la creación e implementación de agentes, brindando a las empresas nuevas herramientas para optimizar sus operaciones con inteligencia artificial.

Potenciando la IA con datos empresariales

Google anunció nuevas mejoras para facilitar la creación de robustos agentes de datos por parte de las organizaciones:

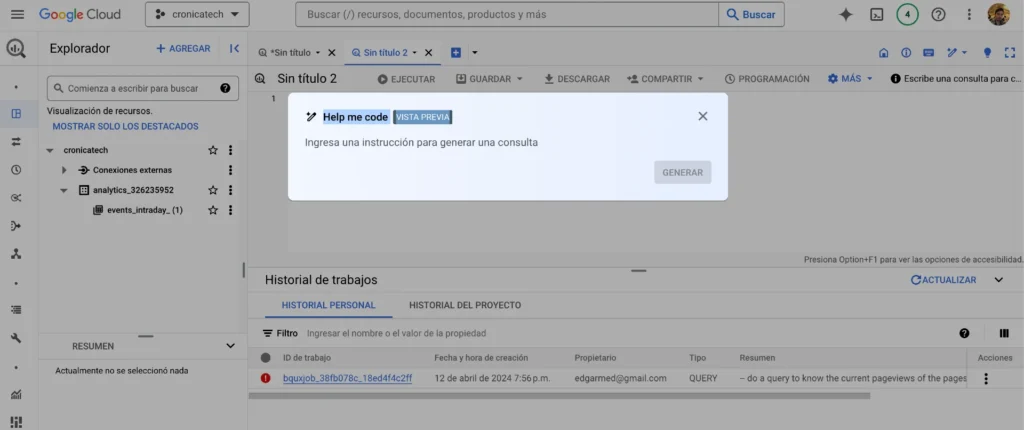

Gemini en BigQuery: Esta función utiliza la inteligencia artificial para asistir a los equipos de datos en la preparación, descubrimiento, análisis y gobernanza de los datos. Además, permite la creación y ejecución de pipelines de datos mediante el nuevo lienzo de datos de BigQuery, que ofrece una experiencia similar a la de un cuaderno con lenguaje natural y visualizaciones integradas, ambas disponibles en versión preview.

Gemini en Databases: Facilita la migración segura de datos desde sistemas legados, por ejemplo, transformando bases de datos tradicionales en modernas bases de datos en la nube como AlloyDB.

Indexación de Vectores: Las nuevas capacidades de consulta que utilizan la indexación de vectores en BigQuery y AlloyDB permiten aplicar la inteligencia artificial directamente sobre los datos almacenados, ofreciendo respuestas precisas y en tiempo real.

Gemini en Looker: Se han introducido nuevas capacidades, actualmente en versión preview, que facilitan la integración de los agentes de datos con los flujos de trabajo existentes. Además, se han añadido nuevas funcionalidades de IA generativa que permiten interactuar con los datos empresariales y están integradas con Google Workspace.

Fortalecimiento de la Ciberseguridad con Tecnologías Impulsadas por IA

A medida que los ataques cibernéticos aumentan tanto en cantidad como en sofisticación, la inteligencia artificial generativa emerge como una herramienta crucial para inclinar la balanza a favor de los defensores. En el evento Google Cloud Next, se anunciaron nuevas innovaciones impulsadas por IA en el portafolio de seguridad de Google, diseñadas para fortalecer los resultados y permitir que las organizaciones integren a Google en sus equipos de seguridad:

Gemini en Threat Intelligence: Esta herramienta utiliza procesamiento de lenguaje natural para proporcionar insights profundos sobre el comportamiento de actores amenazantes. Gemini posibilita el análisis de grandes volúmenes de código potencialmente malicioso, y gracias a su amplia ventana de contexto, permite el análisis de interacciones entre módulos para revelar la verdadera intención detrás del código.

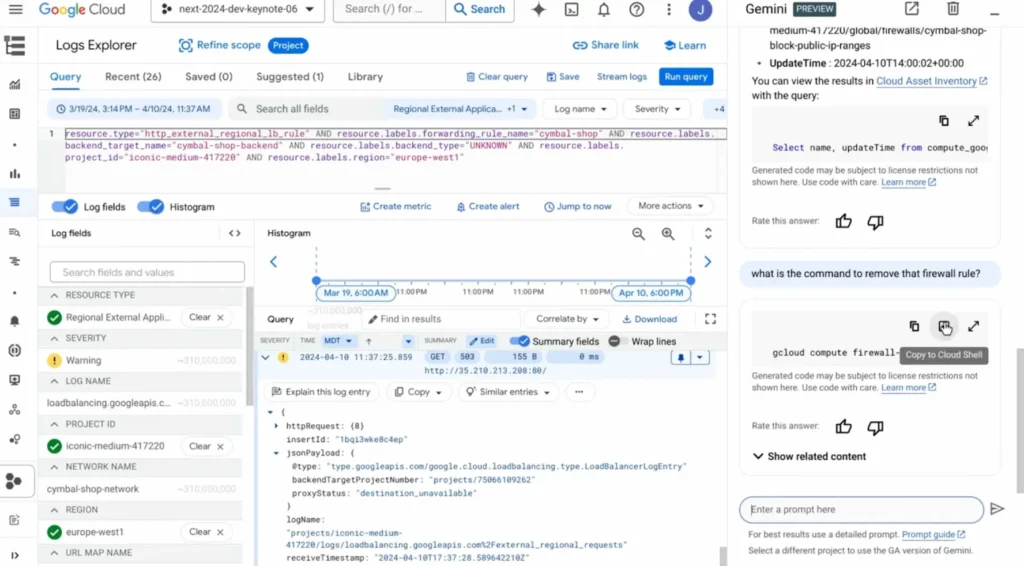

Gemini en Security Operations: Esta nueva funcionalidad de investigación asistida convierte descripciones en lenguaje natural en detecciones, resume los datos de eventos, recomienda acciones a seguir y guía a los usuarios a través de la plataforma mediante chat conversacional.

Empresas reconocidas globalmente ya están experimentando los beneficios de estas innovaciones en seguridad. Por ejemplo, Pfizer ha logrado reducir de días a segundos el tiempo necesario para analizar fuentes de datos. 3M utiliza Gemini en Security Operations para ayudar a su equipo a filtrar el ruido de seguridad. En Fiserv, los ingenieros del Centro de Operaciones de Seguridad pueden crear detecciones y guías con menos esfuerzo, mientras que los analistas obtienen respuestas más rápidamente.

Google Vids apoyará el proceso de producción de video

En el evento, Google anunció la próxima ola de lanzamientos y mejoras para Gemini en Google Workspace, que incluyen:

Google Vids: Una nueva aplicación de Workspace impulsada por IA dedicada a la creación de videos para el trabajo. Vids actúa como un asistente de vídeo, redacción, producción y edición, permitiendo generar storyboards editables, crear borradores iniciales con escenas sugeridas y ofrecer opciones de voz en off. Vids estará disponible en Workspace Labs en junio.

Complemento de mensajería y reuniones de IA: Incluye funciones como “tomar notas por mí”, resumen de chat y traducción en tiempo real en 69 idiomas, a un costo de $10 dólares por usuario al mes.

Nuevo complemento de seguridad de IA: Permite a los administradores de Workspace clasificar y proteger automáticamente archivos y datos confidenciales utilizando modelos de IA con enfoque en la privacidad y controles de prevención de pérdida de datos, disponible por $10 dólares por usuario al mes.

Estas mejoras subrayan el compromiso de Google con la innovación continua en ciberseguridad y productividad empresarial, proporcionando herramientas avanzadas para enfrentar desafíos modernos.