La Autoridad Italiana de Protección de Datos (GPDP) ha decidido bloquear temporalmente el acceso a ChatGPT, un chatbot desarrollado por OpenAI, así lo informó la agencia EFE. Este bloqueo obedece a preocupaciones sobre el manejo de datos personales y posibles infracciones al Reglamento General de Protección de Datos (GDPR) de la UE. La decisión se mantendrá hasta que se determine si OpenAI ha cumplido con las regulaciones del GDPR.

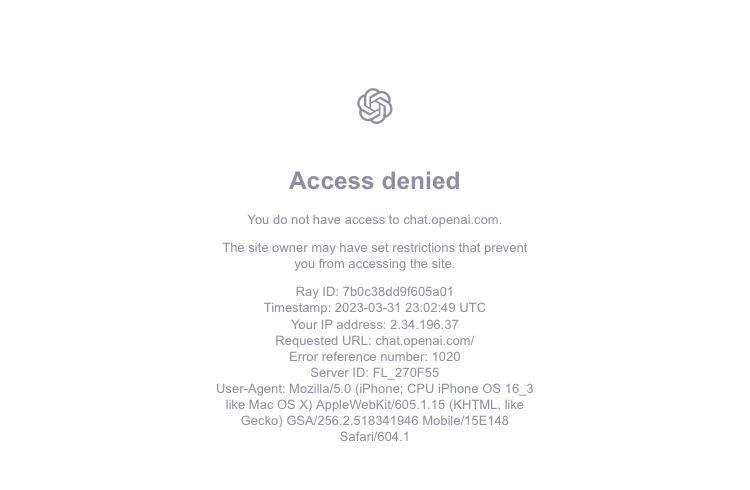

En este momento, así luce ChatGPT en Italia:

Lee también: Análisis: los trabajos que cambiarán por ChatGPT y los que no

La GPDP ha manifestado varias inquietudes relacionadas con ChatGPT, como la falta de una base legal que justifique la recopilación y almacenamiento de datos personales en gran escala para el entrenamiento de sus algoritmos, y la ausencia de información brindada a los usuarios cuyos datos son recabados. Además, la autoridad italiana señala que ChatGPT no siempre suministra información precisa, lo que deriva en el procesamiento incorrecto de datos personales, lo cual también es ilegal según el GDPR.

Otro tema de preocupación para la GPDP es la inexistencia de un filtro de verificación de edad en ChatGPT, que expone a menores a respuestas inadecuadas para su nivel de desarrollo y autoconciencia. OpenAI cuenta con 20 días para abordar las preocupaciones planteadas por la GPDP y describir las medidas adoptadas al respecto.

Este bloqueo acontece después de una carta abierta publicada por una coalición de más de 500 expertos, incluidos nombres como Steve Wozniak y Elon Musk, instando a los laboratorios de IA a detener el entrenamiento de sistemas de IA durante al menos seis meses. La carta subraya la preocupación sobre la falta de planificación y gestión adecuadas en el desarrollo de sistemas de inteligencia artificial avanzados.

Aunque Italia ha sido el primer país en actuar en contra de OpenAI por violar el GDPR, otros países europeos podrían seguir su ejemplo. La Agencia Española de Protección de Datos (AEPD) aún no ha recibido reclamaciones sobre ChatGPT, pero mantiene un ojo vigilante sobre los avances tecnológicos y no descarta futuras investigaciones en el tema.

Esta situación pone de manifiesto la necesidad de regulaciones y supervisión más sólidas en el campo de la inteligencia artificial, así como el desarrollo y aplicación de marcos éticos que aseguren la protección de los derechos de las personas y el uso responsable de la tecnología.

Lee también: ChatGPT-4: análisis técnico de sus capacidades y riesgos

El bloqueo temporal de ChatGPT en la Italia europea podría traer consigo diversas implicaciones para el futuro, tanto para OpenAI como para la industria de la inteligencia artificial en su conjunto:

Revisión en la recolección de datos: OpenAI y otras compañías de IA podrían verse forzadas a reevaluar y ajustar sus prácticas de recolección y almacenamiento de datos personales, buscando cumplir con regulaciones de privacidad como el GDPR.

Mayor observación regulatoria: El bloqueo en Italia podría incentivar a otros países y entidades reguladoras a analizar con mayor detenimiento las prácticas de OpenAI y otras empresas de IA, lo cual podría derivar en investigaciones adicionales, sanciones y cambios en la forma en que estas compañías operan.

Revisión de tecnología de IA: La preocupación sobre la precisión de la información brindada por ChatGPT podría propiciar una mayor inversión en investigación y desarrollo para mejorar la calidad y fiabilidad de los algoritmos de IA, así como la implementación de mecanismos de control de calidad más rigurosos.

Protección de menores: El bloqueo podría impulsar la adopción de medidas de verificación de edad y filtros de contenido más efectivos en servicios de IA para resguardar a los menores de contenido inapropiado y asegurar el cumplimiento de las regulaciones de protección de datos.

Cambios en percepción pública: La controversia alrededor de ChatGPT podría afectar la percepción pública de la inteligencia artificial y generar un debate más amplio sobre ética, privacidad y seguridad en la IA en general. Esto podría influir en la forma en que las empresas de tecnología desarrollan y comercializan sus productos de IA en el futuro.

Desarrollo de marcos regulatorios y éticos: El bloqueo de ChatGPT podría acelerar el desarrollo y adopción de marcos regulatorios y éticos más sólidos en el campo de la inteligencia artificial, asegurando un equilibrio entre la innovación tecnológica y la protección de los derechos de los usuarios.

¿Se avecinan protestas en otros lugares del mundo?

En el panorama actual, distintos grupos y sectores podrían manifestarse en contra de ChatGPT. Entre ellos, los defensores de la privacidad y los derechos digitales podrían alzar la voz si consideran que la tecnología viola la privacidad y los derechos de los usuarios, especialmente en relación con la recolección y el uso de datos personales.

Por otro lado, competidores en la industria de la inteligencia artificial podrían valerse de la controversia en torno a ChatGPT para promocionar sus propias soluciones como alternativas más seguras y conformes a las regulaciones. Además, organizaciones y empresas en áreas sensibles a la información errónea, como la salud, las finanzas, la educación y la política, podrían inquietarse por la posibilidad de que ChatGPT proporcione información incorrecta o engañosa, lo que podría tener consecuencias negativas en sus respectivos campos.

Asimismo, los grupos de protección infantil podrían expresar preocupaciones sobre la exposición de menores a contenido inapropiado a través de ChatGPT, dada la falta de medidas de verificación de edad efectivas. Por último, sindicatos y grupos laborales podrían preocuparse por el impacto de ChatGPT y tecnologías similares en el empleo, especialmente en sectores donde la automatización y la inteligencia artificial podrían reemplazar trabajos humanos, como el soporte al cliente, el periodismo y la traducción.

No resultará extraño empezar a ver protestas no solo en Europa sino en América y en cada rincón del mundo. El miedo en diferentes sectores de la economía es patente. Aunque la inteligencia artificial supone oportunidades, el riesgo de que tenga un impacto negativo profundo en el mediano y largo plazo está patente. La rapidez del cambio supondrá que puede haber sectores de la sociedad imposibilitados para adaptarse y reinventarse a tiempo.

Traducción del la Disposición de 30 de marzo de 2023 de la GPDP

VISTO el Reglamento (UE) 2016/679 del Parlamento Europeo y del Consejo del 27 de abril de 2016 (en adelante, “Reglamento”);

VISTO también el Código en materia de protección de datos personales (d.lgs. 30 de junio de 2003, n. 196);

TOMANDO NOTA de las numerosas intervenciones de los medios de comunicación en relación con el funcionamiento del servicio ChatGPT;

DETECTADO, tras una verificación realizada al respecto, que no se proporciona ninguna información a los usuarios, ni a los interesados cuyos datos han sido recopilados por OpenAI, L.L.C. y procesados a través del servicio ChatGPT;

DETECTADA la ausencia de una base jurídica adecuada en relación con la recopilación de datos personales y su tratamiento con el fin de entrenar los algoritmos subyacentes al funcionamiento de ChatGPT;

DETECTADO que el tratamiento de datos personales de los interesados resulta inexacto, ya que la información proporcionada por ChatGPT no siempre corresponde al dato real;

DETECTADO también la ausencia de cualquier verificación de la edad de los usuarios en relación con el servicio ChatGPT, que, según los términos publicados por OpenAI L.L.C., está reservado para personas que hayan cumplido al menos 13 años;

CONSIDERADO que la falta de filtros para menores de 13 años expone a los mismos a respuestas absolutamente inadecuadas en relación con su grado de desarrollo y autoconciencia;

CONSIDERADO, por lo tanto, que en la situación descrita anteriormente, el tratamiento de datos personales de los usuarios, incluidos los menores, y de los interesados cuyos datos son utilizados por el servicio, viola los artículos 5, 6, 8, 13 y 25 del Reglamento;

IDENTIFICADA, por lo tanto, la necesidad de ordenar, de acuerdo con el artículo 58, párrafo 2, letra f), del Reglamento, de manera urgente y mientras se completa la investigación necesaria con respecto a lo que ha surgido hasta ahora en relación con OpenAI L.L.C., la empresa estadounidense desarrolladora y gestora de ChatGPT, la medida de limitación provisional del tratamiento;

CONSIDERADO que, en ausencia de cualquier mecanismo de verificación de la edad de los usuarios, así como, en cualquier caso, del conjunto de violaciones detectadas, dicha limitación provisional debe extenderse a todos los datos personales de los interesados establecidos en territorio italiano;

CONSIDERADO necesario disponer la mencionada limitación con efecto inmediato a partir de la fecha de recepción de la presente resolución, reservándose cualquier otra determinación al término de la investigación iniciada en el caso;

RECORDADO que, en caso de incumplimiento de la medida dispuesta por el Garante, se aplica la sanción penal del artículo 170 del Código y las sanciones administrativas previstas en el artículo 83, párrafo 5, letra e), del Reglamento;

CONSIDERADO, en base a lo descrito anteriormente, que se cumplen los requisitos para la aplicación del artículo 5, apartado 8, del Reglamento n. 1/2000 sobre la organización y funcionamiento de la oficina del Garante, que establece que “En casos de urgencia particular y necesidad inaplazable que no permitan la convocatoria oportuna del Garante, el presidente puede adoptar las medidas de competencia del órgano, las cuales cesan de tener efecto desde el momento de su adopción si no son ratificadas por el Garante en la primera reunión útil, que se convocará no más allá del trigésimo día”;

VISTA la documentación en el expediente;

TODO LO ANTERIOR PRESENTADO, EL GARANTE:

a) de conformidad con el artículo 58, párrafo 2, letra f), del Reglamento, dispone, con carácter urgente, en relación con OpenAI L.L.C., empresa estadounidense desarrolladora y gestora de ChatGPT, en su calidad de responsable del tratamiento de datos personales realizado a través de dicha aplicación, la medida de limitación provisional del tratamiento de datos personales de los interesados establecidos en territorio italiano;

b) la mencionada limitación surte efecto inmediato a partir de la fecha de recepción de la presente resolución, con reserva de cualquier otra determinación al término de la investigación iniciada en el caso.

El Garante, de conformidad con el artículo 58, párrafo 1, del Reglamento (UE) 2016/679, invita al responsable del tratamiento destinatario de la resolución, además, dentro de los 20 días siguientes a la fecha de recepción de la misma, a comunicar qué iniciativas se han tomado para cumplir con lo prescrito y proporcionar cualquier elemento considerado útil para justificar las violaciones mencionadas anteriormente. Se recuerda que la falta de respuesta a la solicitud de conformidad con el artículo 58 se sanciona con la sanción administrativa establecida en el artículo 83, párrafo 5, letra e), del Reglamento (UE) 2016/679.

De conformidad con el artículo 78 del Reglamento, así como los artículos 152 del Código y 10 del d. lg. 1 de septiembre de 2011, n. 150, contra la presente resolución se puede presentar oposición ante la autoridad judicial ordinaria, mediante recurso depositado en el tribunal ordinario del lugar donde reside el responsable del tratamiento de datos, dentro del plazo de treinta días a partir de la fecha de comunicación de la resolución, o de sesenta días si el recurrente reside en el extranjero.