El 24 de marzo de 2026 quedará inscrito en los anales de la historia de la informática moderna, no por el lanzamiento de un nuevo robot humanoide o un modelo de lenguaje de un trillón de parámetros que acaparara todas las portadas, sino por la publicación de un documento de investigación sumamente técnico por parte de Google Research y DeepMind. A simple vista, el anuncio parecía uno más de los cientos de artículos académicos que se publican semanalmente en el campo de la inteligencia artificial. Sin embargo, su impacto en la industria fue tan brutal, inmediato y profundo que en cuestión de horas desató un auténtico terremoto financiero. El motivo detrás de este pánico colectivo en los mercados tenía un nombre que hoy resuena en todos los centros de datos del mundo: TurboQuant.

Para entender verdaderamente qué es TurboQuant y por qué desencadenó tal nivel de histeria, debemos primero comprender la crisis silenciosa que la industria tecnológica enfrentaba: el temido “RAMpocalypse”. En los años previos a 2026, la carrera armamentística de la inteligencia artificial había dejado de centrarse exclusivamente en la capacidad de razonamiento de los modelos y se había desplazado drásticamente hacia lo que se conoce como la “ventana de contexto”. Las empresas competían ferozmente por ver quién podía procesar más información de una sola vez: libros enteros, bases de código gigantescas, historiales médicos completos o cientos de documentos financieros simultáneamente. Pero esta ambición tenía un precio astronómico en términos de hardware.

A medida que estas ventanas de contexto crecían, el consumo de memoria RAM de video (VRAM) en las costosas unidades de procesamiento gráfico (GPU) se multiplicaba exponencialmente. La industria se encontraba estrellándose contra un muro físico y económico insuperable. Fue en este clímax de tensión tecnológica cuando el equipo de investigadores liderado por Amir Zandieh y Vahab Mirrokni publicó el artículo fundacional en el blog de Google Research. Presentaron un algoritmo capaz de comprimir esta ingente cantidad de memoria hasta seis veces, sin perder absolutamente nada de precisión.

La reacción del mercado no se hizo esperar. En un artículo publicado en Medium titulado “TurboQuant: An algorithm which broke the stock market”, se detalla cómo las acciones de titanes de la fabricación de memoria como Micron, SanDisk y Western Digital se desplomaron repentinamente en más de un 7% en cuestión de minutos tras conocerse la noticia. Los inversores, presas del pánico, razonaron de manera simplista: si Google acaba de inventar una forma de hacer que la inteligencia artificial necesite seis veces menos memoria, la demanda de chips de memoria se va a desplomar y estas empresas perderán su principal motor de crecimiento. Como veremos más adelante, este razonamiento impulsivo ignoraba por completo las leyes fundamentales de la economía de la innovación, pero sirvió para demostrar el inmenso poder disruptivo que un simple avance matemático puede tener sobre la infraestructura global multimillonaria de la IA.

La devoradora de recursos: entendiendo la KV cache de la inteligencia artificial

Para desentrañar el misterio de TurboQuant qué es exactamente, es imperativo realizar un viaje técnico a las entrañas de los Grandes Modelos de Lenguaje (LLMs) como GPT, Claude, Gemma o Mistral. En el corazón de todas estas inteligencias artificiales modernas late una arquitectura matemática revolucionaria presentada en 2017 conocida como el “Transformer”. Esta arquitectura se basa en un mecanismo fundamental llamado “atención” (attention mechanism), que permite al modelo comprender qué palabras o conceptos en una frase están relacionados entre sí, sin importar cuán separados estén en el texto.

Sin embargo, este mecanismo de atención tiene un talón de Aquiles computacional masivo. Cuando interactúas con un LLM, este no genera la respuesta de golpe; lo hace token por token (palabra por palabra, o fragmento de palabra). Para que el modelo mantenga el hilo de la conversación y no olvide lo que te acaba de decir o lo que tú le dijiste hace diez párrafos, necesita almacenar representaciones matemáticas de todo ese contexto previo. Estas representaciones se guardan en matrices de números multidimensionales conocidas como Claves (Keys) y Valores (Values). A este almacén temporal de datos se le denomina, en la jerga de la ingeniería de software, la “KV Cache” (Caché de Clave-Valor).

La KV Cache actúa, en esencia, como la memoria de trabajo o memoria a corto plazo del modelo, a diferencia de sus “pesos” (weights), que representarían su memoria a largo plazo o su conocimiento general del mundo. El problema catastrófico de la KV Cache es su naturaleza acumulativa. Por cada nuevo token que envías o que el modelo genera, se añaden nuevos vectores matemáticos a esta caché. Y no creas que son números pequeños; estamos hablando de vectores de alta dimensión (a menudo miles de dimensiones por cada atención) almacenados en formatos de alta precisión de 16 bits. Cuando tienes una ventana de contexto de cientos de miles de tokens, el tamaño físico de esta memoria de trabajo explota.

Para ponerlo en perspectiva, antes de la invención de este nuevo algoritmo de Google, un modelo de tamaño moderado procesando un contexto largo podía fácilmente saturar por completo la memoria ultrarrápida (HBM) de una GPU NVIDIA H100 de 80 GB, un componente de hardware que cuesta decenas de miles de dólares. En la inferencia a gran escala, el cuello de botella dejó de ser la capacidad de cálculo puro (los teraflops de la tarjeta gráfica); el problema era simplemente la falta de espacio para almacenar y mover la memoria. Los ingenieros pasaban más tiempo intentando que los datos cupieran en la RAM que mejorando la inteligencia del modelo. La latencia aumentaba, el costo por consulta se disparaba y la viabilidad económica de aplicaciones de IA a gran escala pendía de un hilo. Aquí es exactamente donde la tecnología de cuantización entró en juego como un salvavidas.

La magia matemática: PolarQuant, QJL y la geometría elegante

La cuantización no es un concepto completamente nuevo en la ciencia de datos. Históricamente, se ha utilizado la cuantización de vectores para reducir el tamaño de los datos redondeando valores de alta precisión a representaciones más crudas (por ejemplo, pasar de números decimales de 16 bits a números enteros de 8 bits). Sin embargo, los métodos tradicionales solían sufrir de una de dos maldiciones fatales: o bien destruían demasiada información y volvían al modelo errático y alucinante, o bien requerían procesos de calibración extremadamente lentos y específicos para cada conjunto de datos, usando técnicas como los diccionarios de códigos k-means, que los hacían inviables para operar “sobre la marcha” (en tiempo real) durante una conversación de IA.

La investigación detallada en el documento TurboQuant: Online Vector Quantization with Near-optimal Distortion Rate, publicada en abril de 2025 y refinada para su despliegue masivo en marzo de 2026, demostró que era posible esquivar ambos problemas simultáneamente. TurboQuant logró reducir drásticamente la huella de memoria (llevándola de 16 bits hasta apenas 3.5 o 2.5 bits por canal) manteniendo la precisión geométrica de los vectores casi intacta. Y lo hizo sin necesidad de entrenamientos previos con datos específicos, lo que en el argot técnico se conoce como un algoritmo “data-oblivious” (ajeno a los datos).

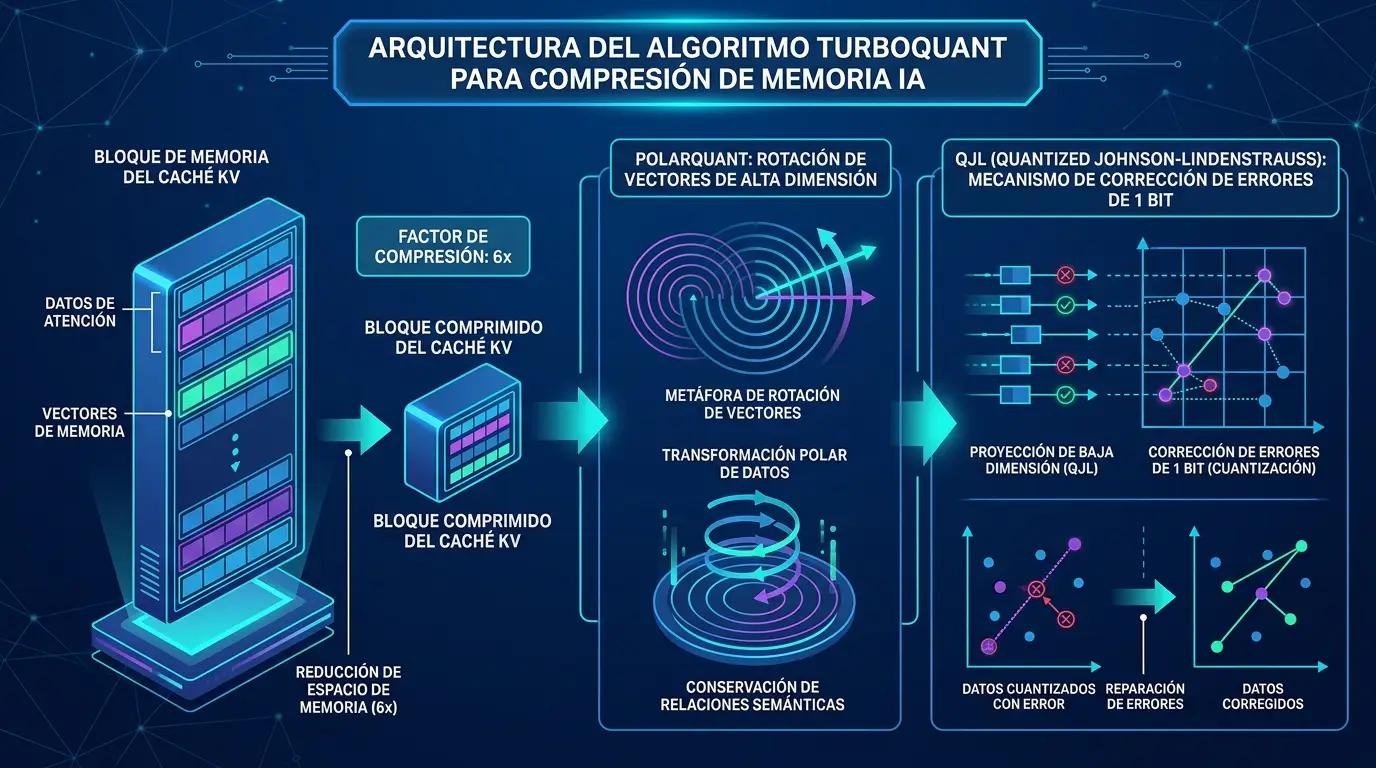

¿Cómo se logra este milagro técnico? A través de una geometría asombrosamente elegante, dividida en un enfoque de múltiples etapas que combina dos algoritmos subyacentes críticos: PolarQuant y Quantized Johnson-Lindenstrauss (QJL).

La primera fase del proceso recae sobre los hombros de PolarQuant. El objetivo aquí es una compresión inicial de alta calidad. Para entenderlo, imagina que tienes un punto en un mapa de tres dimensiones. TurboQuant comienza aplicando una rotación ortogonal aleatoria a estos vectores de entrada. Aunque suene a pura magia arcana, esta rotación es un paso matemáticamente deliberado que obliga a la información a distribuirse de manera más uniforme a través de todas las dimensiones, induciendo una distribución de probabilidad conocida como distribución Beta. Al dispersar la importancia de la información, el algoritmo puede aplicar un cuantizador escalar óptimo de tipo Lloyd-Max a cada coordenada de forma independiente, asegurando que se capture la “esencia” o fuerza principal del vector original con la menor cantidad de bits posible. Este paso utiliza la mayor parte del presupuesto de bits asignado (por ejemplo, 2 o 3 bits de los 3.5 totales).

Pero PolarQuant por sí solo deja un pequeño problema, lo que los expertos en compresión de Google denominan el “sesgo residual”. Cuando optimizas la memoria basándote en el error cuadrático medio (MSE), inevitablemente introduces pequeñas distorsiones sistemáticas al calcular el producto interno entre vectores, una operación matemática vital para que la IA sepa qué palabras son relevantes. Si permites que este sesgo se acumule en una ventana de miles de tokens, el LLM perderá el contexto, se confundirá y dará respuestas erróneas o incoherentes.

Aquí es donde entra la segunda genialidad del sistema: el algoritmo QJL (Quantized Johnson-Lindenstrauss). TurboQuant toma ese pequeño residuo matemático de error que dejó PolarQuant y le aplica un transformador QJL utilizando lo que la literatura llama el “truco de 1 bit” (1-bit trick). Este último bit, en lugar de intentar almacenar más información de valor, actúa como un verificador y corrector de errores matemático extremadamente sofisticado. Evalúa el error residual y lo codifica usando un solo bit que representa un signo (positivo o negativo). Este corrector elimina de tajo el sesgo sistemático, garantizando que el producto interno final (las puntuaciones de atención del modelo) siga siendo insesgado y matemáticamente puro, sin importa cuánto hayamos comprimido los datos originales.

El resultado final, tal como señala el análisis del ingeniero Prateek Karkare en su extenso desglose en Medium, es un algoritmo de compresión que está teóricamente garantizado para operar a un factor de apenas ~2.7 del límite absoluto e insuperable establecido por la teoría de la información. Este margen de 2.7x no es un error de los ingenieros, sino la penalización teórica mínima y provablemente irreductible que existe al intentar encajar una distribución geométrica generada por la rotación dentro de las rigurosas matemáticas de la cuantización gaussiana. El resultado en la práctica es rotundo: compresión fenomenal con neutralidad de calidad absoluta.

Pruebas empíricas: rompiendo los benchmarks de la industria

Por supuesto, una teoría matemática brillante en un documento académico no garantiza el éxito en el sucio y caótico mundo real de los servidores de producción. Por eso, el equipo de investigación no se limitó a publicar ecuaciones; sometió su algoritmo a un escrutinio brutal utilizando los modelos de código abierto más avanzados del momento, incluyendo Gemma, Llama 3.1 Instruct, Mistral, Molmo2 y arquitecturas de Mezcla de Expertos (MoE) como Qwen.

Los resultados de estos benchmarks fueron descritos por la prensa especializada en ciberseguridad y tecnología profunda, como el portal Help Net Security, como simplemente asombrosos. En el temido banco de pruebas conocido como “Needle In A Haystack” (Aguja en un pajar) —una prueba de estrés donde se esconde un dato diminuto y específico dentro de un documento masivo de miles y miles de palabras para ver si la IA puede encontrarlo— TurboQuant logró un éxito aplastante. Incluso aplicando una compresión severa que reducía la memoria caché KV a un cuarto de su tamaño original, la recuperación de la información alcanzó un 100% de precisión hasta en contextos de 104,000 tokens. No hubo ni un solo signo de amnesia inducida por la compresión.

Pero las pruebas no terminaron ahí. Evaluado a través de las cinco principales suites de pruebas de contextos largos, incluyendo LongBench, ZeroSCROLLS, RULER y L-Eval, el algoritmo demostró que no requería ningún tipo de re-entrenamiento exhaustivo o ajuste fino (fine-tuning) para funcionar perfectamente. Al operar a 3.5 bits por valor de caché, igualó punto por punto los resultados del modelo operando a plena precisión de 16 bits. Al reducirlo a 2.5 bits, la degradación observada fue tan pequeña que apenas resultaba estadísticamente significativa para tareas prácticas como resumen de textos, generación de código o respuesta a preguntas de razonamiento complejo.

Además, al resolver el problema del ancho de banda de memoria, TurboQuant destrancó un enorme potencial de velocidad de cálculo que antes estaba retenido. Al tener que mover seis veces menos datos entre la memoria y los núcleos de procesamiento de las GPUs NVIDIA H100, la aceleración fue dramática. Las operaciones de decodificación y cálculo de atención (attention logits) reportaron incrementos de velocidad de hasta 8 veces en comparación con el cálculo no cuantizado en arquitecturas de hardware modernas. Esto significaba que los centros de datos no solo podían alojar conversaciones mucho más largas y complejas consumiendo la misma RAM, sino que también podían entregar las respuestas a los usuarios mucho más rápido, reduciendo drásticamente los costos operativos en infraestructura de inteligencia artificial.

La adopción por la comunidad de código abierto fue fulminante. Poco después del anuncio, investigadores líderes de la industria, como Awni Hannun (creador del framework de inteligencia artificial de Apple, MLX), no tardaron en realizar pull requests como el documentado en GitHub, integrando el algoritmo para que pudiera ejecutarse eficientemente en ecosistemas de desarrollo alternativos, comprobando independientemente que la compresión de 4.9x y 3.8x del caché KV de hecho resultaba en una precisión milimétrica, sin pérdida de capacidades en la IA. Sistemas integrales de inferencia y bases de datos vectoriales comenzaron de inmediato la transición hacia esta nueva metodología para potenciar de forma radical el rendimiento global de la cadena de software tecnológico.

El impacto financiero: del pánico inicial a la paradoja de Jevons

Retomemos la reacción histérica de Wall Street de la que hablamos al comienzo de este artículo. La caída de gigantes de la memoria como Micron, SK Hynix, Samsung Electronics y Western Digital se fundamentaba en una lógica aparentemente inquebrantable, pero en el fondo profundamente errónea: si la tecnología consume un sexto de la memoria que necesitaba ayer, la demanda de hardware de almacenamiento se reducirá en la misma proporción, destruyendo miles de millones en valor de mercado futuro. Sin embargo, analistas económicos y tecnólogos visionarios intervinieron rápidamente para apagar este incendio y cambiar radicalmente la narrativa dominante, convirtiendo el miedo inicial en un optimismo arrollador.

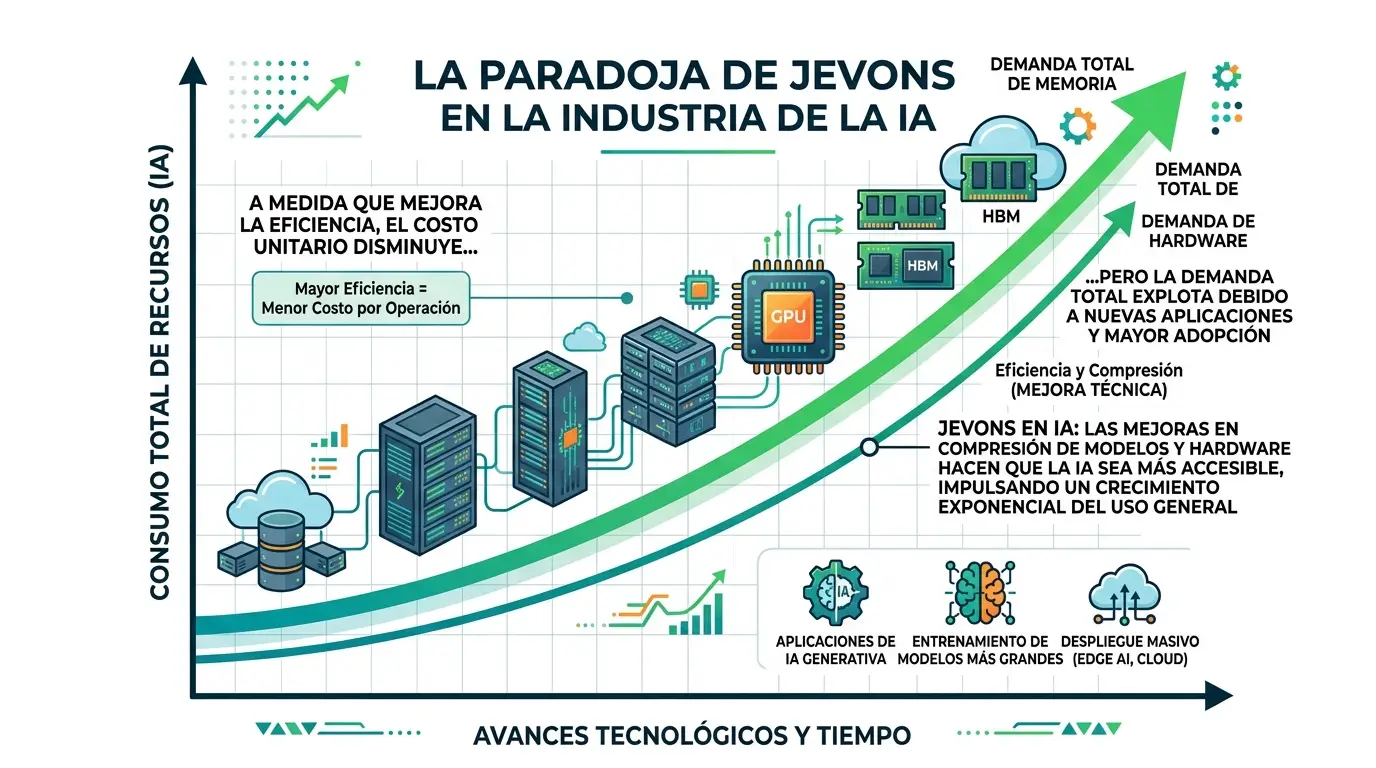

Para desmentir este pánico, expertos económicos recurrieron a un principio establecido hace más de siglo y medio: La Paradoja de Jevons. Formulada en el siglo XIX por el economista británico William Stanley Jevons durante la Revolución Industrial, esta paradoja establece que, contrariamente a la intuición, a medida que las mejoras tecnológicas aumentan la eficiencia con la que se utiliza un recurso, el consumo total de dicho recurso tiende a aumentar, no a disminuir. Jevons lo observó con el carbón: cuando las máquinas de vapor se volvieron mucho más eficientes y usaban menos carbón por caballo de fuerza, la energía se volvió más barata y rentable, lo que llevó a la proliferación masiva de fábricas e industrias enteras basadas en el vapor, disparando astronómicamente el consumo total de carbón a nivel nacional.

Aplicando este brillante principio a la inteligencia artificial de 2026, la ecuación resulta clarividente. Thomas Coughlin, escribiendo un profundo análisis para la revista Forbes en su artículo Google’s TurboQuant Compression Could Increase Demand For AI Memory, argumentó magistralmente que hacer que la IA requiera menores requisitos de memoria vuelve a la tecnología infinitamente más útil y rentable en miles de escenarios previamente imposibles. Si el costo computacional por token generado se desploma gracias a TurboQuant, las empresas no apagarán sus servidores ni dejarán de comprar chips; simplemente ejecutarán modelos mucho más grandes, desarrollarán bases de datos semánticas más complejas y llevarán la ventana de contexto de cientos de miles de tokens a decenas de millones de tokens continuos. El mercado entero de la IA pasaría de un cuello de botella restrictivo a una era de expansión sin precedentes.

Esta perspectiva fue ecoada vigorosamente por veteranos de la inversión y la tecnología. En una aparición muy comentada en el canal de YouTube económico Chosun Money, Hong Jin-chae, CEO de Raccoon Asset Management, fue categórico respecto a este malentendido monumental. Según relató, el propósito de esta invención jamás fue “comprar menos memoria”. El origen del desarrollo fue lidiar con la asfixiante escasez global de memoria que limitaba a la IA. “Si una compañía piensa, ‘ahora que podemos comprimir el caché KV con TurboQuant, debemos comprar menos memoria’, están fuera de sus cabales. El espacio extra creado por la compresión debe asignarse a mayor computación o usarse para expandir la ventana de contexto para historiales de conversación más largos”.

Como resultado de estos sobrios análisis financieros, las acciones de los principales fabricantes de semiconductores rebotaron bruscamente en las semanas posteriores. El mercado comprendió que, lejos de un apocalipsis, TurboQuant era en realidad el mejor regalo que la industria del hardware de memoria podría haber recibido: un catalizador indispensable que aseguraba que el crecimiento y la penetración comercial de la IA inteligente y a gran escala pudiera continuar su ascenso meteórico sin estrellarse fatalmente contra el límite físico de la VRAM actual.

Hacia el futuro: la democratización del edge computing y la IA móvil

Quizás la consecuencia más emocionante y duradera de lo que significa TurboQuant para el ciudadano de a pie es la revitalización de un concepto tecnológico que se había quedado rezagado en la explosión de la IA generativa: el “Edge Computing” (computación en el borde).

Hasta mediados de esta década, la sabiduría convencional dictaba que para obtener inteligencia artificial de altísima calidad, estabas obligado a depender de los monumentales centros de datos en la nube de gigantes como Microsoft, Amazon o Google. Ejecutar un LLM de nivel comercial con un razonamiento complejo y contextos profundos en un teléfono inteligente, un reloj inteligente o un dispositivo del Internet de las Cosas (IoT) era ciencia ficción, puramente debido a las insalvables restricciones de memoria, refrigeración y batería. Un modelo fundacional avanzado con un contexto amplio requería decenas de gigabytes de memoria ultrarrápida, algo imposible de miniaturizar para tu bolsillo, obligando a tu teléfono móvil a enviar cada consulta a la nube, incurriendo en latencias indeseables y serios riesgos de privacidad de datos de los usuarios.

Pero al reducir los requisitos de memoria del caché en un factor de seis veces sin la más mínima merma en las capacidades cognitivas, el algoritmo TurboQuant ha hecho estallar estos límites de hardware preestablecidos. Analistas de mercado inmediatamente señalaron que empresas fabricantes de procesadores móviles como Qualcomm, Broadcom o Apple son los gigantes dormidos que podrían ser los principales beneficiarios de este quiebre tecnológico a largo plazo.

Si la huella de memoria en tiempo de ejecución (inferencia) puede comprimirse hasta requerir apenas 3.5 bits por parámetro en las claves y valores dinámicos, esto permite introducir potentes asistentes de inteligencia artificial general directamente en el propio chip del teléfono inteligente. Hablamos de IA local, completamente soberana, libre de suscripciones a servidores remotos, invulnerable a cortes de internet y herméticamente segura para manejar los correos electrónicos más privados, registros financieros personales o conversaciones íntimas, sin que esos datos abandonen físicamente el dispositivo móvil. TurboQuant no solo salvó a los centros de datos corporativos de ahogarse en su propia ambición, sino que accidentalmente diseñó la llave maestra matemática para democratizar la supercomputación de inteligencia artificial y ponerla, literalmente, en las palmas de nuestras manos.